YouTube постепенно внедряет официальные функции дубляжа на нескольких языках, но многие инди-творцы и технические основатели либо еще не имеют к ним доступа, либо хотят получить больший контроль над качеством, задержкой и стоимостью. Если вы когда-нибудь мечтали посмотреть любое видео на YouTube на своем родном языке с естественным звуком вместо субтитров, вы думаете о дубляже ИИ в реальном времени. В этом руководстве мы расскажем о том, как разработать и создать прототип собственной системы, которая будет переводить звук YouTube на лету и передавать дублированную дорожку обратно зрителю.

Попутно мы сравним встроенные функции YouTube с браузерными расширениями и пользовательскими конвейерами, а также рассмотрим, как унифицированная платформа для создателей, такая как UUININ, с ее модулями для создания контента с использованием искусственного интеллекта и оптимизации видео, обработки звука и интеллектуальной автоматизации рабочих процессов, может значительно упростить развертывание и поддержку такого многоязычного опыта в масштабе. Когда вы объединяете ASR, перевод, TTS, аналитику и публикацию, наличие этих компонентов под одной крышей имеет большее значение, чем кажется.

Что уже предлагает YouTube (и почему этого недостаточно)

Прежде чем потратить ни один час на создание собственной инфраструктуры, следует понять, что YouTube уже предоставляет. YouTube теперь поддерживает мультиязычные аудиодорожки, позволяя создателям загружать аудиофайлы на разных языках и давать зрителям возможность переключать дорожки, как на Netflix. Для некоторых партнерских каналов YouTube даже тестирует автодубляж на основе искусственного интеллекта, который может генерировать переведенный звук для контента в стиле знаний с минимальными усилиями создателей.

YouTube постепенно внедряет автодубляж с поддержкой искусственного интеллекта для большего числа создателей, особенно для каналов, ориентированных на образовательный и информационный контент, как сообщалось в недавнем материале об автодубляже с поддержкой искусственного интеллекта на YouTube.Автодублирование с помощью искусственного интеллекта

Функция мультиязычных звуковых дорожек позволяет прикреплять несколько аудиофайлов к одному видео, чтобы зрители могли переключать языки, не открывая новый URL-адрес, о чем подробно рассказывается в описании мультиязычных звуковых дорожек YouTube.многоязычные аудиодорожки

Эти функции мощные, но они не универсальны и не работают в режиме реального времени. Доступ к ним часто зависит от региона, статуса канала и графика экспериментов YouTube. Многие создатели, участвующие в программе Partnered, по-прежнему сообщают, что не могут загружать мультиязычные треки или ждут очереди на дубляж ИИ.

Некоторые авторы рассказывают, что у них до сих пор нет доступа к мультиязычным аудиодорожкам, несмотря на партнерство, что расстраивает, если вы серьезно настроены на глобальный охват.по-прежнему нет доступа

Если ваша стратегия развития зависит от календаря развертывания YouTube, вы фактически позволяете экспериментальному флагу решать, может ли ваш контент стать глобальным.

Именно поэтому многие разработчики и небольшие медиакоманды создают собственные системы дубляжа в реальном времени, которые работают поверх YouTube: расширения для браузеров, сопутствующие веб-приложения или даже полноценные SaaS-платформы, которые обеспечивают многоязычное аудио независимо от того, что показывает YouTube.

Конвейер дубляжа с искусственным интеллектом в реальном времени: ASR → MT → TTS → потоковое вещание

В основе любой системы дубляжа YouTube с искусственным интеллектом в реальном времени лежит четырехступенчатый конвейер:

- ASR (Automatic Speech Recognition) - захват исходного аудио и преобразование его в текст.

- MT (Machine Translation) - перевод текста на целевой язык.

- TTS (Text-to-Speech) - синтез естественной речи на целевом языке, в идеале - голосом, похожим на оригинальный.

- Потоковая передача и синхронизация - передача синтезированного звука слушателю практически в реальном времени, при этом он должен быть согласован с видео.

В теории это звучит просто, но на практике на каждом этапе приходится искать компромисс между скоростью, точностью и стоимостью. Давайте рассмотрим каждый компонент и решения, которые вам придется принять.

Этап 1: захват и расшифровка аудиозаписей с YouTube (ASR)

Во-первых, вам нужен необработанный аудиопоток. Для браузерного расширения вы обычно захватываете звук из видеоэлемента HTML5 или через Web Audio API. Получив аудиокадры, вы передаете их в ASR-модель, такую как Whisper, wav2vec 2.0 или облачный API.

- ASR на устройстве и в облаке - ASR на устройстве позволяет избежать потоковой передачи пользовательского звука на сервер, но при этом более требователен к процессору и ограничен ограничениями браузера.

- Транскрибация - обычно вы транскрибируете фрагментами (например, 0,5-2 секунды), чтобы сбалансировать задержку и точность.

- Шумы и акценты - в реальном мире YouTube звук грязный: фоновая музыка, комментарии, несколько дикторов.

В большинстве систем реального времени ASR работает в потоковом режиме, когда модель выдает частичные транскрипты по ходу дела. Вам придется иметь дело с пересмотром транскрипта: модель может обновить свои предположения о последних нескольких словах, когда услышит больше контекста. Это хорошо для субтитров; для TTS это означает, что вам не следует говорить слишком далеко от подтвержденной транскрипции, иначе вы рискуете услышать исправления.

Этап 2: Перевод на лету (машинный перевод)

Получив текст, вы отправляете его через систему перевода. Можно использовать облачные API, модели с открытым исходным кодом или гибрид. Для контента в стиле YouTube сложными задачами являются идиомы, сленг и время.

- Латентность - перевод должен быть достаточно быстрым, чтобы на каждый чанк приходилось не более нескольких сотен миллисекунд.

- Стиль - нужен ли вам дословный перевод или адаптация шуток и отсылок?

- Контекст - чанкированный ASR означает, что ваша система МТ видит короткие сегменты; поддерживать контекст между сегментами очень сложно.

Один из прагматичных подходов заключается в том, чтобы рассматривать ранние слова как малозначимые: вы быстро переводите с помощью общей модели, а затем настраиваете систему для таких важных сегментов, как видеозаписи, спонсорские чтения и призывы к действию, где нюансы имеют наибольшее значение.

Этап 3: преобразование текста в речь и сохранение голоса

Теперь у вас есть переведенный текст, и вам нужна озвучка. Вы можете либо использовать общие голоса TTS, либо попытаться клонировать голос, чтобы дублированный звук звучал так же, как у создателя оригинала. Клонирование голоса обеспечивает большее погружение, но связано с юридическими и этическими соображениями, особенно если вы дублируете сторонний контент без прямого разрешения.

- TTS в реальном времени - вам нужна модель, способная синтезировать речь достаточно быстро для потоковой передачи.

- Просодия - хороший TTS должен соответствовать темпу и эмоциям; плоские голоса будут ощущаться как плохой GPS.

- Постоянство голоса - как только зритель выбирает голос, он должен оставаться неизменным в разных сегментах и даже в разных видео.

Отличный прием - намеренное отставание дублированного звука от видео на небольшую фиксированную задержку (например, 1-3 секунды). Это дает вашему конвейеру достаточно пространства для дыхания, чтобы генерировать более естественную просодию, не звуча как сломанный радиоприемник, пытающийся наверстать упущенное.

Этап 4: Потоковая передача, буферизация и синхронизация

Наконец, вам нужно передать дублированный звук пользователю в реальном времени, сохраняя его согласованность с визуальным рядом. В расширении для браузера вы можете внедрить `AudioContext` и воспроизвести собственную звуковую дорожку, отключив или приглушив оригинальный звук YouTube. Если вы создадите отдельное веб-приложение, вы можете загрузить проигрыватель YouTube IFrame Player, отключить звук и транслировать собственное аудио через WebRTC или пользовательское решение на основе WebSocket.

| Компонент | Ключевой бюджет задержки |

|---|---|

| ASR (потоковое вещание) | 100-400 мс на чанк |

| Машинный перевод | 50-200 мс на чанк |

| Преобразование текста в речь | 100-400 мс на чанк |

| Сеть и буферизация | 100-300 мс |

| Итого, от конца к концу | 350-1 300 мс в типичном случае |

Если общая задержка в трубопроводе не превышает одной секунды, многие зрители с этим смирятся, особенно если речь идет об образовательном или комментаторском контенте. В быстро развивающихся играх или спортивных трансляциях задержка будет ощущаться сильнее, и вам, возможно, придется поступиться точностью ради скорости.

Создание и использование: Существующие инструменты и собственные архитектуры

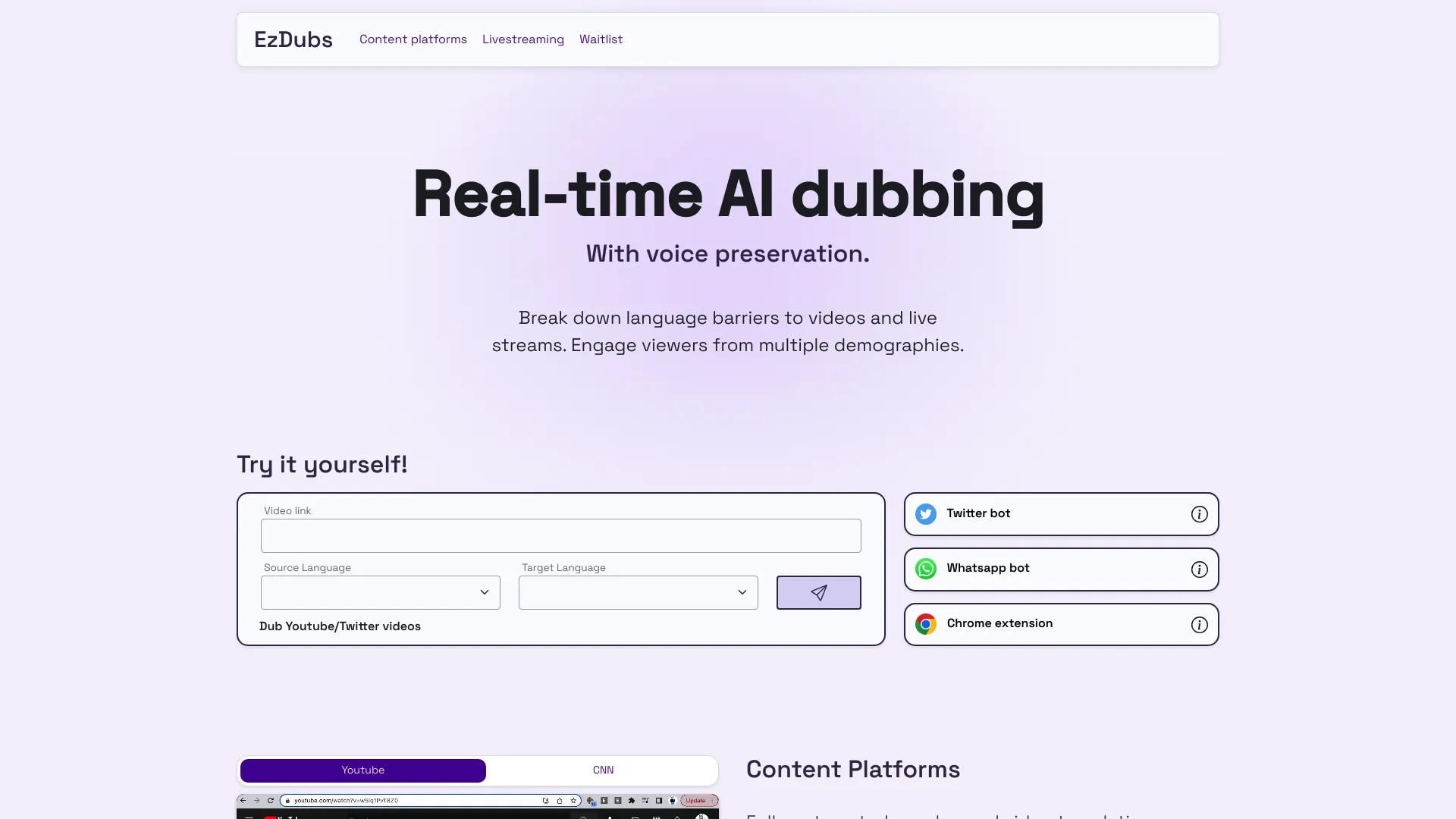

Если все это звучит как множество движущихся частей, то так оно и есть. Хорошая новость заключается в том, что уже существуют инструменты и сервисы, на которых вы можете учиться или даже использовать их в качестве первой версии своего продукта.

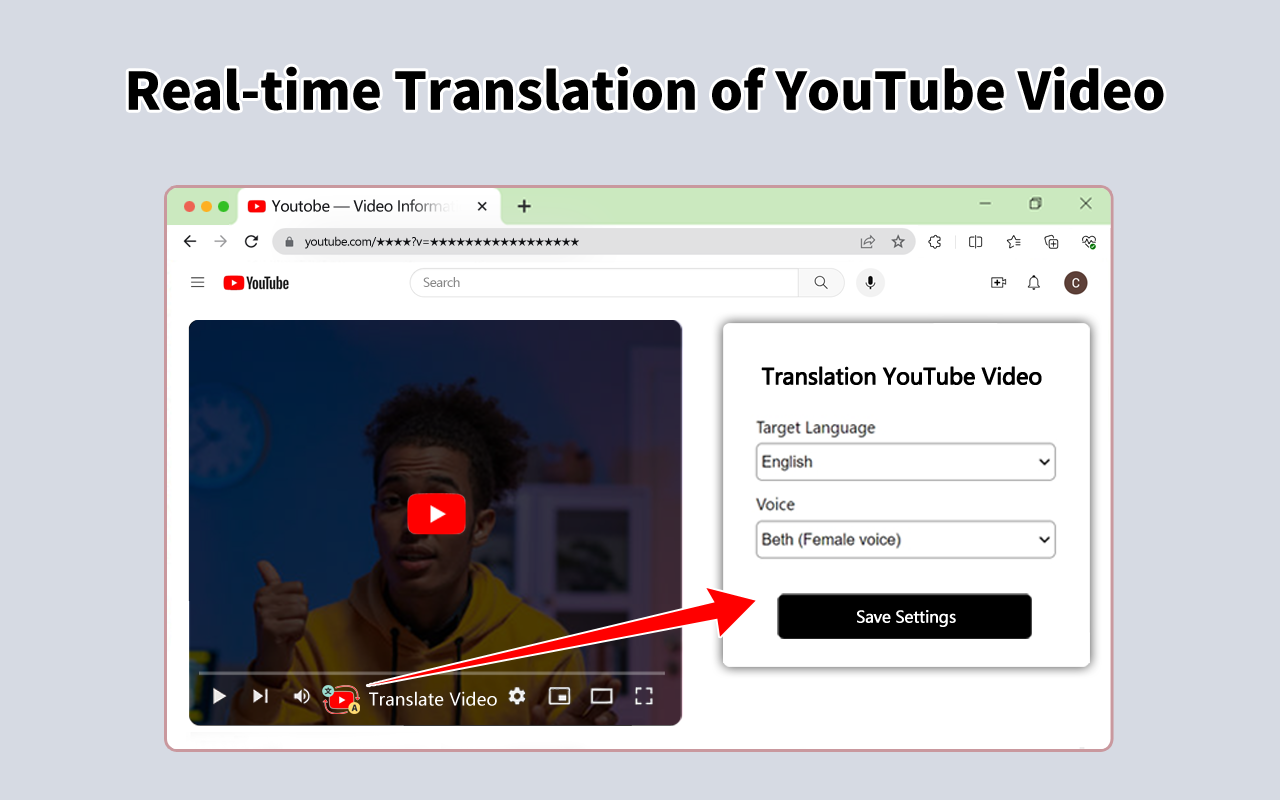

Например, Transmonkey предлагает дубляж в реальном времени на более чем 130 языках через расширение для браузера, что дает вам отличную точку отсчета для оценки UX и производительности.дубляж в режиме реального времени на более чем 130 языках

Кроме того, YouTube проводит эксперименты по улучшению пользовательского интерфейса с учетом особенностей разных стран, например, миниатюр на разных языках, а также настраивает систему открытий, чтобы локализованные версии могли распространяться по всему миру. Очевидно, что многоязычие больше не является нишей - это ожидание по умолчанию.

Сообщения о том, что YouTube тестирует новые функции миниатюр, помогающие видео путешествовать по всему миру, свидетельствуют о том, что платформа все больше оптимизируется для трансграничного обнаружения.Видеоролики путешествуют по всему миру

Однако если вы являетесь техническим основателем или хотите тесно интегрировать дубляж с собственным продуктом, в какой-то момент вам понадобится собственная архитектура. В этом случае вам придется думать не только о компонентах ML, но и о планировании, аналитике, монетизации и обслуживании - областях, которые на удивление болезненны, если вы полагаетесь на пять отдельных SaaS-инструментов, склеенных вместе скотчем.

Почему стек создателей "все в одном" имеет значение

В типичной системе "сделай сам" может использоваться один поставщик для ASR, другой - для перевода, третий - для TTS, отдельная панель для аналитики и еще один инструмент для планирования и публикации многоязычного контента. Каждая интеграция - это маленькая мина: лимиты API, истекающие сроки действия маркеров доступа, непоследовательное ведение журналов и тикеты в службу поддержки, переходящие от одного поставщика к другому, когда что-то идет не так.

Именно здесь и проявляется преимущество подхода на основе единой платформы. Например, UUININ объединяет возможности ИИ по созданию контента, такие как расширенный видеомонтаж, обработка звука и автоматическое создание контента, с инструментами оптимизации ИИ для интеллектуальных рекомендаций и автоматизации рабочего процесса. В контексте дубляжа в реальном времени это означает, что вы можете прототипировать конвейер ASR → перевод → TTS, отслеживать задержки и вовлеченность, а также вносить данные о производительности в график публикации и языковую стратегию - и все это в рамках одной экосистемы, а не с помощью нескольких приборных панелей.

Зачем жонглировать 5+ различными инструментами, если вы можете управлять редактированием AI, многоязычным аудио, аналитикой и публикацией с помощью одной платформы, которая на самом деле знает, как весь ваш рабочий процесс сочетается друг с другом?

Помимо экономии абонентской платы, более тонким преимуществом является оптимизация: когда конвейер дубляжа, временная шкала редактирования и аналитика аудитории имеют общие данные, вы можете ответить на такие вопросы, как "Дубляж на каком языке заставляет зрителей смотреть дольше?" и "Должны ли мы автодублировать прямые трансляции или только VOD?" без ручного экспорта CSV.

От прототипа к продукту: Работающие UX-шаблоны

Если вы разрабатываете дизайн для зрителей, то доминируют две модели UX: браузерные расширения, дополняющие сайт YouTube, и веб-приложения-компаньоны, встраивающие плеер YouTube. Расширения чувствуют себя более родными (вы остаетесь на youtube.com), в то время как веб-приложения дают вам больше контроля над макетом и иногда легче поставляются кроссбраузерно.

- Выбор языка - простой выпадающий элемент или тумблер рядом с плеером необходим; пользователи должны иметь возможность мгновенно переключаться между оригинальным и дублированным звуком.

- Индикатор задержки - подумайте о небольшом значке "Live" или "+0,8 с", чтобы установить ожидания относительно задержки.

- Режимы возврата - при падении качества вместо потокового аудио можно вернуться к субтитрам или показать предупреждение.

Для создателей может понадобиться режим "авторской правки", в котором они будут просматривать дубляж, корректировать терминологию (названия продуктов, повторяющиеся шутки) и фиксировать важные фразы перед публикацией. Именно здесь ценным становится редактирование с помощью искусственного интеллекта: вместо того чтобы вручную вырезать и перезаписывать реплики, система может за считанные минуты создать сегменты с обновленным переводом или произношением.

Создание практичного стека для дубляжа в реальном времени

Давайте соберем все части вместе в практичную архитектуру, которую может создать инди-команда. Вам не нужно изобретать ASR или TTS с нуля; ваша задача - организовать конвейер и разработать пользовательский опыт.

- Расширение для браузера или веб-приложение захватывает аудио с YouTube короткими фрагментами (например, 1 секунда).

- Чанки передаются на бэкэнд через WebSocket (или каналы данных WebRTC для снижения накладных расходов).

- Бэкэнд выполняет потоковую ASR, передает частичные транскрипты в службу перевода.

- Переведенный текст поступает в TTS-движок с низкой задержкой, который выдает аудиокадры.

- Бэкэнд передает синтезированные аудиокадры обратно в браузер.

- Передняя панель воспроизводит дублированный звук с небольшой фиксированной задержкой, приглушая или ослабляя звук оригинальной дорожки.

- Аналитика регистрирует выбор языка, задержку и количество завершений для последующей оптимизации.

Если вы в первую очередь создатель, а не инженер по инфракрасным технологиям, то, скорее всего, сначала вы будете использовать управляемые API ASR/MT/TTS. По мере роста использования вы можете перейти на модели с открытым исходным кодом, размещенные на собственных графических процессорах, чтобы контролировать расходы.

И здесь снова поможет платформенный подход. ИИ-стек для создания контента UUININ, который уже занимается ИИ-монтажом видео, улучшением изображений и обработкой звука, может служить центральным узлом, где ваш конвейер дубляжа будет жить вместе с рабочим процессом редактирования. Вместо того чтобы экспортировать дублированный звук, повторно импортировать его в отдельный редактор и вручную загружать на YouTube, вы можете автоматизировать всю цепочку: генерировать многоязычный звук, объединять его с вашими временными рамками и планировать загрузку или потоковую передачу на несколько платформ с помощью инструментов создателя для планирования и многоплатформенной публикации. Это очень экономит время, если вы ведете несколько каналов и языков.

Команды, создающие SaaS на основе этого, могут предложить режимы реального времени и пакетный: реальное время для живых событий и инструментов "смотри, как просматриваешь", пакетный - для предварительной обработки целых каталогов на нескольких языках с более высоким качеством и низкой поминутной стоимостью.

Стоимость, качество и юридические аспекты

Обработка ИИ в реальном времени не бесплатна. Вы платите за вычисления, пропускную способность и часто дорогие TTS-голоса. Хитрость заключается в том, чтобы привести качество в соответствие с доходами: разумно тратить больше средств на высокоценный контент, такой как спонсируемые видео, флагманские серии или премиум-курсы, и использовать более дешевые модели или даже субтитры для экспериментов с низкой рентабельностью.

- Масштабирование вычислений - используйте автомасштабирование и маршрутизацию по языкам, чтобы не тратить GPU на пустые комнаты.

- Кэширование - часто воспроизводимые сегменты (интро, аутро) можно кэшировать как предварительно отрендеренное аудио.

- Согласие - если вы клонируете голос автора, получите явное разрешение; если вы дублируете сторонний контент, соблюдайте авторские права и условия платформы.

Юридическая сторона вопроса - это не просто шаблон: в некоторых юрисдикциях несанкционированное клонирование или перевод голоса может вызвать реальные проблемы. В случае сомнений используйте по умолчанию типовые голоса и будьте прозрачны в общении с пользователями относительно того, что генерирует ИИ и как это используется.

С точки зрения рабочего процесса, легко потратить часы на объединение биллинга, разрешений и аналитики использования от нескольких поставщиков. Такая система, как UUININ, объединяющая в себе искусственный интеллект для автоматизации рабочих процессов и анализа производительности с механизмом монетизации и аналитической панелью, может быть особенно эффективной, если вы планируете монетизировать дубляж - будь то платный доступ на нескольких языках, сотрудничество с брендами или дополнительные продажи. Вы можете направить данные о многоязычной вовлеченности непосредственно в логику монетизации вместо того, чтобы пытаться собрать их из разрозненных сервисов.

В конечном счете, главный вопрос заключается в том, хотите ли вы вечно заниматься склеиванием пяти или шести API или предпочитаете будущее, в котором ваш конвейер дубляжа ИИ, стек редактирования, мультиязычная публикация и монетизация являются частью одной интеллектуальной экосистемы создателей. Платформы, подобные UUININ, указывают на такое консолидированное будущее: вы создаете творческий опыт - многоязычный, в режиме реального времени, отзывчивый - а платформа берет на себя тяжелую работу по редактированию ИИ, оптимизации контента, автоматизации рабочих процессов и кросс-платформенному развертыванию, чтобы вы могли сосредоточиться на создании видео, которое стоит переводить в первую очередь.

Действительно ли мне нужен AI-дубляж в реальном времени, или достаточно предварительных дублей?

Если ваш контент в основном предварительно записан (учебники, эссе, обзоры), то дубляжа в реальном времени обычно достаточно, и он может быть более качественным, поскольку вы можете его редактировать и просматривать. ИИ-дубляж в реальном времени проявляет себя, когда вам нужен живой или полуживой опыт: потоки, премьеры или браузерные инструменты "смотри любое видео на любом языке", которые работают на произвольных каналах.

Какой опыт кодирования мне нужен для создания прототипа?

Вы должны хорошо владеть JavaScript или TypeScript для работы в браузере, а также языком бэкенда (Node, Python или Go) для организации ASR, MT и TTS. Вам не нужно быть экспертом в области машинного обучения; вы можете начать с управляемых API и при необходимости заменить их на собственные модели.

Сделают ли официальные функции YouTube в конечном итоге устаревшими пользовательские решения?

Встроенные в YouTube функции мультиязычного аудио и дубляжа с помощью искусственного интеллекта охватывают многие общие случаи использования, особенно для крупных каналов. Однако для нишевых рабочих процессов, кросс-платформенного распространения, тонкого контроля качества перевода и продуктов, которые находятся между YouTube и зрителем (расширения, приложения, образовательные платформы), по-прежнему будут востребованы собственные решения. Думайте об этом как о встроенном редакторе YouTube и внешних редакторах: оба сосуществуют.

Как обеспечить достаточно низкую задержку для прямых трансляций?

Используйте потоковые ASR и TTS, сохраняйте небольшие размеры чанков (0,5-1 секунда), минимизируйте межрегиональные переходы и будьте готовы обменять некоторую сложность перевода на скорость. Фиксированная небольшая задержка около одной секунды приемлема для большинства зрителей и дает вашему конвейеру возможность передохнуть.

Стоит ли создавать собственную инфраструктуру или воспользоваться универсальной платформой для создателей?

Если вы любите работать с инфраструктурой и нуждаетесь в глубокой кастомизации, вам подойдет собственный стек. Но если ваша главная цель - эффективная публикация и монетизация контента, то платформа "все-в-одном", объединяющая в себе процессы редактирования, дубляжа, аналитики и монетизации с использованием искусственного интеллекта - подобно UUININ, - скорее всего, позволит вам выйти на рынок быстрее и с гораздо меньшими операционными издержками.