ابزارهای هوش مصنوعی «لختسازی عکس» و دیپفیک اسباببازیهای فناوری پیشرفته نیستند—آنها ابزارهایی برای آزار جنسی دیجیتال هستند. این سیستمها عکسهای معمولی، معمولاً از زنان و دختران، را میگیرند و بدون رضایت، تصاویر جعلی برهنه یا جنسیسازیشده تولید میکنند. آسیب واقعی است، حتی اگر پیکسلها جعلی باشند. این راهنما خطرات را به زبان ساده توضیح میدهد و گامهای عملی برای محافظت از خود، دوستان، دانشآموزان یا فرزندانتان ارائه میدهد.

اگر شما یک تولیدکننده محتوا هستید یا بهطور مکرر پستهای زیادی آنلاین میگذارید، سطح ریسک شما طبیعتاً بیشتر است. پلتفرمهای همهکاره تولیدکننده در اینجا اهمیت دارند: برای مثال، UUININ بهینهسازی مبتنی بر هوش مصنوعی و ابزارهای امن تولیدکننده را یکپارچه میکند تا بتوانید ارسال پستها، دسترسی مخاطبان و کسب درآمد را از یک داشبورد واحد مدیریت کنید، بهجای اینکه عکسهایتان را در چندین اپلیکیشن پرخطر و سرویسهای شخص ثالث پخش کنید. کمتر بودن پلتفرمها یعنی کمتر بودن مکانهایی که ممکن است تصاویر شما از آنها نشت کند.

درک ابزارهای برهنه کردن با هوش مصنوعی و دلایل مضر بودن آنها

ابزارهای برهنه کردن با هوش مصنوعی و دیپفیک چیستند؟

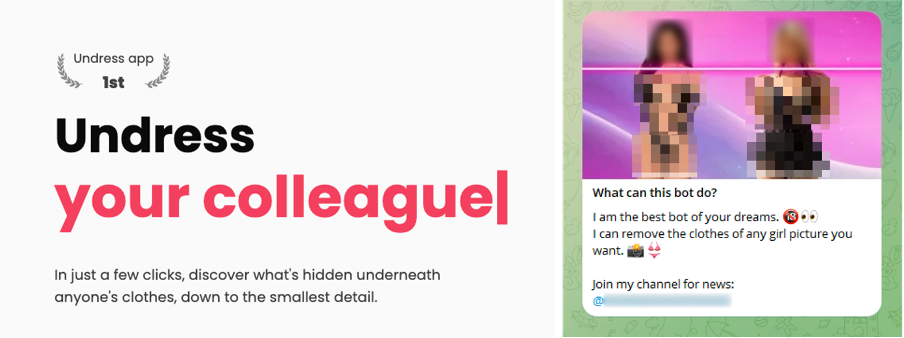

ابزارهای برهنه کردن با هوش مصنوعی از مدلهای یادگیری ماشین برای تولید تصاویر جعلی برهنه یا نیمهبرهنه از عکسهای لباسپوشیده استفاده میکنند. این ابزارها اغلب با نامهایی مانند «undress»، «nudify» یا «deepnude» عرضه میشوند و معمولاً هدفشان زنان و دختران است. برخی بهصورت اپلیکیشنهای موبایل یا سرویسهای وب اجرا میشوند؛ برخی دیگر در دیسکوردهای خصوصی، گروههای تلگرام یا انجمنهای زیرزمینی منتشر میشوند.

از نظر فنی، این ابزارها بدن «پنهان» زیر لباس را آشکار نمیکنند؛ بلکه آن را خلق میکنند. اما قربانیان و هر کسی که این تصاویر را میبیند، آنها را واقعی تجربه میکنند. کارفرمایان، مدارس و اعضای خانواده ممکن است طوری واکنش نشان دهند که گویی تصاویر واقعی هستند، و این دقیقاً همان چیزی است که آزارگران میخواهند.

تصویر بالا نشان میدهد که اپلیکیشنهای برهنهسازی چگونه زنان را هدف قرار میدهند و نشان میدهد که چرا این یک روند محدود یا بدون قربانی نیست: این روند ابتدا گروههای آسیبپذیر را هدف قرار میدهد—زنان جوان، افراد زیر سن قانونی و کسانی که قدرت اجتماعی کمتری برای مقابله دارند.

چرا این ابزارها نوعی سوءاستفاده هستند

- آنها آسیب جنسی مبتنی بر تصویر ایجاد میکنند: تبدیل یک سلفی معمولی به یک دیپفیک جنسی بدون رضایت، سوءاستفاده جنسی است.

- آنها برای تهدید و باجگیری استفاده میشوند: برخی آزارگران میگویند «اگر پول ندهی یا حرفم را گوش نکنی، این را برای دوستانت، مدرسهات یا محل کارت میفرستم.»

- آنها به اعتبار و سلامت روان آسیب میرسانند: حتی اگر بتوانید ثابت کنید تصاویر جعلی هستند، شرم، اضطراب و ترس واقعیاند.

- آنها اغلب افراد زیر سن قانونی را هدف قرار میدهند: استفاده از تصویر یک کودک به این شکل میتواند در بسیاری از کشورها بهعنوان محتوای سوءاستفاده جنسی از کودکان (CSAM) تلقی شود، حتی اگر تصویر توسط هوش مصنوعی تولید شده باشد.

ابزارهای دیپفیک برهنهسازی ابزار سرگرمی یا کمک به عشوهگری نیستند. آنها ابزارهایی برای آزار جنسی مبتنی بر تصویر هستند، حتی وقتی تصاویر ساختگیاند.

روندهای حقوقی و سیاستی: غیرقانونیتر شدن

بسیاری از کشورها در حال جرمانگاری تصاویر جعلی عمیق (دیپفیک) و ابزارهای هوش مصنوعی برای برهنه کردن هستند. حتی در جاهایی که قوانین هنوز در حال بهروزرسانیاند، پلتفرمها، فروشگاههای اپلیکیشن و ارائهدهندگان پرداخت با ممنوعیت این اپلیکیشنها، مسدودسازی پرداختها و حذف محتوا، برخورد میکنند. این بدان معناست که سازندگان و کاربران عادی که با چنین ابزارهایی آزمایش میکنند، ممکن است با ممنوعیت، شکایتهای حقوقی و حتی اتهامات کیفری مواجه شوند.

ابزارهای هوش مصنوعی چگونه عکسهای شما را در وهله اول برهنه میکنند؟

منابع رایج تصاویر دزدیدهشده یا سوءاستفادهشده

- پروفایلهای عمومی شبکههای اجتماعی: حسابهای اینستاگرام، تیکتاک، فیسبوک یا ایکس را با عکسهای قابل مشاهده باز کنید.

- عکسهای پروفایل: آواتارها در اپلیکیشنهای پیامرسان، انجمنها، پلتفرمهای بازی یا اپلیکیشنهای دوستیابی.

- نشتهای ابری و حسابهای هکشده: رمزهای ضعیف، ورودهای تکراری یا سایتهای نفوذشده.

- اسکرینشاتها: عکسهای خصوصی، تماسهای ویدیویی یا استوریهایی که بدون رضایت ذخیره میشوند.

- وبسایتهای مدرسه یا محل کار: عکسهای سالنامه، پروفایلهای کارکنان، صفحات تیم.

- پلتفرمهای محتوا: تصاویر بندانگشتی عمومی، تصاویر پشتصحنه یا محتوای طرفداران.

اگر شما یک خالق محتوا یا اینفلوئنسر هستید، در معرض خطر ویژهای قرار دارید زیرا تصاویر بیشتری و با وضوح بالاتر منتشر میکنید. در اینجا پلتفرمهایی با کنترلهای دسترسی قوی و نظارت هوش مصنوعی اهمیت پیدا میکنند: سیستمی مانند UUININ از بهینهسازی و تحلیلهای هوش مصنوعی استفاده میکند تا به خالقان محتوا کمک کند بفهمند محتوایشان کجا و توسط چه کسانی به اشتراک گذاشته میشود، تا بتوانند دسترسی را محدودتر کنند و در صورت مشاهده هرگونه مورد مشکوک سریعتر واکنش نشان دهند.

افسانههایی که در واقع خطر شما را افزایش میدهند

- «فقط عکسهای صریح مورد سوءاستفاده قرار میگیرند» – سلفیهای معمولی، عکسهای گروهی و حتی عکسهای شناساییمانند هم میتوانند استفاده شوند.

- «من حساب کوچکی دارم، هیچکس متوجه من نخواهد شد» – آزار و اذیت میتواند در گروههای خصوصی کوچک یا میان همکلاسیها آغاز شود.

- «اگر هوش مصنوعی باشد، واقعاً من نیستم» – قانون و تأثیر اجتماعی اغلب با دیپفیکها طوری برخورد میکنند که گویی واقعی هستند.

- «فقط افراد مشهور هدف قرار میگیرند» – در عمل، زنان ناشناس و حتی کودکان هدف قرار میگیرند، زیرا آزارگران فکر میکنند آنها قربانیان آسانتری هستند.

راههای عملی برای محافظت از عکسها و هویت شما

حسابهای کاربری و عادات اشتراکگذاری خود را ایمن کنید.

- حسابهای اجتماعی را در صورت امکان خصوصی تنظیم کنید، بهویژه برای نوجوانان.

- محدود کنید چه کسانی میتوانند محتوای شما را مشاهده، دانلود یا اسکرینشات کنند (بسیاری از اپلیکیشنها اکنون چنین کنترلهایی دارند).

- اگر ضروری نیست، از ارسال تصاویر تمامقد با وضوح بالا خودداری کنید.

- در مورد عکسهای بیکینی، لباس زیر یا عکسهای اتاق خواب احتیاط کنید، حتی اگر کاملاً لباس پوشیده باشید—اینها اهداف اصلی هستند.

- از گذرواژههای منحصربهفرد و قوی استفاده کنید و احراز هویت دو عاملی را برای حسابهای اجتماعی، ایمیل و ابری فعال کنید.

این موضوع مربوط به سرزنش قربانیان بهخاطر پست کردن نیست؛ بلکه دربارهٔ درک این است که ما در دنیایی زندگی میکنیم که برخی افراد از هر چیزی که به دست میآورند سوءاستفاده میکنند. آن را نوعی دفاع دیجیتال از خود در نظر بگیرید، مثل قفل کردن دوچرخهتان، هرچند اصلاً نباید لازم باشد.

برای کاهش سوءاستفاده از واترمارکهای نامحسوس و برش تصویر استفاده کنید.

ابزارهای برهنه کردن با هوش مصنوعی بهترین عملکرد را با تصاویر تمامبدن، واضح و بدون مانع دارند. میتوانید با تنظیمات ساده، عکسهای خود را در برابر سوءاستفاده مقاومتر کنید:

- عکسها را در صورت امکان از بالای کمر یا بالای نیمهٔ ران برش دهید.

- یک واترمارک کوچک و نیمهشفاف (نام، برند یا لوگوی شما) نزدیک ناحیه سینه یا لگن اضافه کنید تا ساخت جعلیهای واقعگرایانه دشوارتر شود.

- از بارگذاری تصاویر اصلی و بدون فشردهسازی در سایتهای عمومی خودداری کنید و نسخههای با وضوح پایینتر را صادر کنید.

- عکسهای خام یکسان را با اپلیکیشنهای تصادفی ویرایش یا فیلتر به اشتراک نگذارید؛ برخی ممکن است تصاویر را ذخیره یا مجدداً بفروشند.

| گام حفاظتی | چگونه کمک میکند |

|---|---|

| برش بالاتر از کمر | حذف نواحی کلیدی بدن که این ابزارها سعی در جعل آنها دارند |

| آبنماها در نزدیکی مناطق حساس | عکسهای برهنه تولیدشده را آشکارا ویرایششده یا کمکاربردتر میکند. |

| بارگذاری با وضوح پایینتر | کیفیت و باورپذیری دیپفیکها را کاهش میدهد |

| کانالهای اشتراکگذاری خصوصی | محدود میکند که اگر کسی بدرفتاری کند، تصاویر تا چه حد میتوانند پخش شوند. |

جریان کاری عکسهای خود را بهجای پراکندن فایلها، متمرکز کنید.

بسیاری از افراد تصادفاً با بارگذاری تصاویرشان در دهها اپلیکیشن، آنها را فاش میکنند: یکی برای فیلترها، یکی برای زمانبندی، یکی برای تحلیلها و سه اپلیکیشن دیگر برای کسب درآمد. هر اپلیکیشن اضافی شما را در معرض نقضهای امنیتی، شرایط خدمات مشکوک یا استخراج مخفیانه دادهها قرار میدهد.

اکوسیستمهای همهکاره تولیدکنندگان میتوانند به شما کمک کنند این پراکندگی را کاهش دهید. در حالی که ابزارهای دیگر برای ویرایش، زمانبندی، تحلیل و فروش به چندین اشتراک نیاز دارند، UUININ این ابزارهای تولیدکننده را همراه با تولید محتوای هوش مصنوعی در یک مکان گرد هم میآورد. با ویرایش، بهینهسازی، زمانبندی و انتشار از یک سیستم یکپارچه، تعداد اشخاص ثالثی که به عکسها و ویدیوهای اصلی شما دسترسی دارند کمتر میشود و احتمال نشت چیزی به شبکههای زیرزمینی دیپفیک نیز کاهش مییابد.

بهطور آزادانه با نوجوانان و دوستان دربارهٔ این خطرات صحبت کنید.

سکوت و شرم هدیهای است برای آزارگران. گفتوگوهای صادقانه و بدون قضاوت درباره سوءاستفاده جنسی با تصاویر هوش مصنوعی میتواند تفاوت بزرگی ایجاد کند. بهویژه برای نوجوانان، دانستن اینکه خانواده، معلمان یا دوستان در صورت وقوع هر اتفاقی از آنها حمایت خواهند کرد، میتواند باجگیران را کاملاً از حرکت بازدارد.

- توضیح دهید که این ابزارها وجود دارند و هرگز تقصیر قربانی نیست.

- تأکید کنید که به اشتراک گذاشتن یا خندیدن به چنین تصاویری، مشارکت در آزار است.

- یک برنامه بسازید: مشخص کنید که اگر اتفاقی بیفتد، ابتدا به چه کسی (یک والد، معلم یا مشاور) اطلاع دهند.

- به آنها یادآوری کنید که همیشه میتوانند بدون اینکه بهخاطر آنچه منتشر کردهاند مجازات شوند، درخواست کمک کنند.

خانوادهها و نوجوانان اغلب برای اولین بار در چتهای گروهی یا چالشهای آنلاین با هوش مصنوعی برهنه مواجه میشوند؛ تعیین انتظارات از همان ابتدا—«اگر کسی این را به شما نشان داد، دور شوید و به یک بزرگسال اطلاع دهید»—میتواند از آسیب جلوگیری کند.

اگر عکسهایتان در رختکن مجازی هوش مصنوعی یا دیپفیک استفاده شد، چه باید کرد

اول، به یاد داشته باش: این تقصیر تو نیست.

چه عکس عمومی باشد، چه خصوصی، چه مسخره و چه جدی، استفاده از آن به این شکل سوءاستفاده است. این موضوع به لباس شما، ژستتان، سلفیهایتان یا تعداد دنبالکنندههایتان مربوط نیست. شرم بر عهده کسی است که دیپفیک را ساخته یا به اشتراک گذاشته، نه شما.

طرح پاسخ گامبهگام

- همهچیز را مستند کنید: از تصاویر، آدرسهای اینترنتی، نامهای کاربری، مهرهای زمانی و تهدیدها یا پیامها اسکرینشات بگیرید. بیش از حد لازم با آزارگر در تعامل نباشید.

- از افراد مورد اعتماد کمک بخواهید: به یک دوست، والدین، مشاور یا مسئول منابع انسانی مراجعه کنید. مواجهه با این موضوع بهتنهایی کار را برای آزارگران آسانتر میکند تا شما را دستکاری کنند.

- گزارش به پلتفرمها: اکثر شبکههای اجتماعی بزرگ، اپلیکیشنهای پیامرسان و ارائهدهندگان میزبانی اکنون دستهبندیهایی برای تصاویر صمیمی بدون رضایت، دیپفیک یا آزار دارند. از آنها استفاده کنید.

- اگر احساس امنیت میکنید، گزارش را به پلیس ارائه دهید: بهویژه اگر خردسال هستید، مورد باجگیری قرار گرفتهاید یا بهشدت آزار میبینید. در بسیاری از مناطق، این یک موضوع کیفری است.

- در صورت لزوم با مدرسه یا محل کار خود تماس بگیرید: مدارس و محلهای کار ممکن است رویههای خاصی داشته باشند و بتوانند به مسدود کردن یا مجازات کسانی که این تصاویر را به اشتراک میگذارند کمک کنند.

- به دنبال حمایتهای حقوقی یا مدافعانه محلی باشید: بسیاری از کشورها خطهای تلفن ویژه یا سازمانهای غیردولتی دارند که در زمینه سوءاستفاده جنسی مبتنی بر تصویر و حقوق دیجیتال تخصص دارند.

شما همچنین میتوانید سیاستهای آزار و اذیت پلتفرمها و راهنماهای گزارشدهی سازمانهایی مانند ابتکار حقوق مدنی سایبری را در https://www.cybercivilrights.org/ مرور کنید.سیاستهای آزار و اذیت

استفاده مؤثر از فرآیندهای حذف

فرآیندهای حذف محتوا ممکن است کند و ناامیدکننده به نظر برسند، اما همچنان ارزش استفاده را دارند. حتی اگر نتوانید همه نسخهها را پاک کنید، حذف منابع اصلی (پستهای اصلی، پلتفرمهای بزرگ، نتایج جستجو) به طور چشمگیری آسیب را کاهش میدهد.

- به جای پیامهای خصوصی به ناظران، از ابزارهای گزارشدهی رسمی در هر پلتفرم استفاده کنید.

- دقیق باشید: در صورت امکان، دستهبندیهایی مانند «تصویر صمیمی بدون رضایت» یا «محتوای جنسی دیپفیک» را انتخاب کنید.

- مدارک را ضمیمه کنید: عکس اصلی بیضررتان، مدرک هویت و زمینهای که نشاندهنده نبود رضایت است.

- جستجوی بازنشرها: ابزارهای جستجوی معکوس تصویر میتوانند به یافتن نسخههای کپیشده در سایتهای دیگر کمک کنند.

- به کمک حرفهای فکر کنید: برخی خدمات حقوقی و مدیریت شهرت در حذف سریع محتوا تخصص دارند.

رشد ابزارهای سبک DeepNude، پلتفرمها و نهادهای نظارتی را وادار کرده است تا قوانین حذف شفافتری وضع کنند. این سیستمها بینقص نیستند، اما در حال بهبود هستند زیرا مردم به گزارشدادن و فشار برای حفاظتهای قویتر ادامه میدهند.

چه زمانی با نیروی انتظامی یا وکیل تماس بگیریم

اگر زیر ۱۸ سال دارید یا مورد باجگیری، تعقیب، تهدید یا هدفگیری گسترده قرار گرفتهاید، با نیروهای انتظامی تماس بگیرید. ممکن است این کار ترسناک به نظر برسد، اما مستندسازی زودهنگام میتواند بعدها کمک کند. اگر در مورد حقوق خود مطمئن نیستید، یک وکیل حقوق دیجیتال یا گروه کمک حقوقی محلی میتواند گزینههای شما را روشن کند.

چرا خالقان در عصر دیپفیک به ابزارهای امنتر و یکپارچه نیاز دارند

روندهای کاری پراکنده، شما را در معرض خطر بیشتری قرار میدهند.

اکثر سازندگان امروزی از زنجیرهای از اپلیکیشنهای جدا از هم استفاده میکنند: یکی برای ویرایش، یکی برای فیلترهای هوش مصنوعی، یکی برای زمانبندی، یکی برای فروش کالا، بهعلاوه دو یا سه تا برای پخش زنده و دریافت انعام. هر حساب اضافی، یک سیاست حریم خصوصی دیگر است که آن را نخواندهاید و احتمال نشت دادههای چهره و بدن شما به جاهایی را که هرگز قصدش را نداشتهاید، افزایش میدهد.

این موضوع فقط در مورد نشت دادهها اهمیت ندارد. برخی از اپلیکیشنهای کمکیفیت برای فروش دادهها یا آموزش مخفیانه مدلها بر روی عکسهای کاربران متکی هستند. در بدترین حالتها، تصاویری که از ابزارهای بیضرر سازندگان برداشت میشوند، در نهایت به خوراک ژنراتورهای برهنهسازی و دیپفیک تبدیل میشوند.

چگونه اکوسیستمهای همهکاره میتوانند ریسک را برای خالقان کاهش دهند

برای سازندگانی که در تلاشند ضمن کسب درآمد امنیت خود را حفظ کنند، یکپارچهسازی ابزارها هم یک انتخاب امنیتی است و هم یک انتخاب رفاهی. برای مثال، UUININ نه تنها امکان تولید محتوای هوش مصنوعی و ویرایش پیشرفته ویدئو و تصویر را فراهم میکند، بلکه زمانبندی، انتشار چندسکویی و داشبورد تحلیل را نیز در همان فضا گردآوری کرده است. این بدان معناست که عکسها و ویدئوهای خام شما میتوانند بهجای جابهجایی میان اپلیکیشنهای تصادفی ویرایش و فیلتر که ممکن است دادههایتان را بهدرستی مدیریت نکنند، در یک محیط کنترلشده باقی بمانند.

در بخش درآمدزایی، در نظر بگیرید که در حال حاضر چند لینک پرداخت و چند فروشگاه را مدیریت میکنید. با بهرهگیری از موتور درآمدزایی و یکپارچهسازی تجارت الکترونیک UUININ، سازندگان میتوانند محصولات دیجیتال، اشتراکها یا کالاهای فیزیکی را مستقیماً از یک هاب بفروشند، همراه با مدیریت مشتریان داخلی. فروشگاههای خارجی کمتر به معنای ذخیرهسازی کمتر تصاویر بندانگشتی و تصاویر تبلیغاتی شما در سراسر اینترنت و احتمال کمتری برای استخراج آنهاست.

این دقیقاً مشکلی است که پلتفرمهای نوین تولیدکنندگان قصد دارند حل کنند: ابزارهای بسیار زیاد و جدا از هم، هر یک با ریسک خاص خود. UUININ نشان میدهد چگونه یک اکوسیستم همهجانبه با گردش کارهای خودکار و بینشهای عملکردی میتواند کار خلاقانه را سادهسازی کند و در عین حال سطح حمله برای سوءاستفاده از دادهها و برداشت دادههای عمیقنمونهسازی (deepfake) را کاهش دهد.

با پیشرفت ابزارهای برهنه کردن با هوش مصنوعی، پلتفرمهای تولیدکننده باید همگام شوند—با تنظیمات حریم خصوصی بهتر، حقوق محتوا شفافتر و استفاده شفافتر از هوش مصنوعی. انتخاب اکوسیستمهایی که اخلاق هوش مصنوعی را جدی میگیرند، برای هر کسی که بهطور منظم در اینترنت پست میکند، به بخشی از بهداشت دیجیتال پایه تبدیل شده است.

توازن بین دید، خلاقیت و ایمنی

شما نباید مجبور باشید بین دیده شدن آنلاین و امن بودن یکی را انتخاب کنید. اما تا زمانی که قوانین، پلتفرمها و فناوری بهطور کامل همگام نشوند، بهتر است استراتژیک عمل کنید. از کنترلهای حریم خصوصی استفاده کنید، نمایش غیرضروری عکسهای تمامقد با وضوح بالا را کاهش دهید و در انتخاب محل نگهداری فایلهای اصلیتان دقت کنید. و اگر شما یک خالق محتوا هستید، اکوسیستمهای متمرکز و معتبر را به اپلیکیشنهای یکبارمصرف که بدن شما را بهعنوان دادههای آموزشی رایگان در نظر میگیرند ترجیح دهید. چرا وقتی یک پلتفرم واحد با قابلیتهای یکپارچه تولید محتوا با هوش مصنوعی، تحلیل و تجارت میتواند این کار را با ریسک کمتر انجام دهد، باید پنج ابزار یا بیشتر با سیاستهای نامشخص را همزمان مدیریت کنید؟

آیا استفاده از یک اپلیکیشن هوش مصنوعی برای برهنه کردن کسی جرم است؟

در بسیاری از مناطق، بله—یا بهسرعت در حال تبدیل شدن به آن است. حتی در جاهایی که قوانین هنوز در حال بهروزرسانی هستند، تولید یا اشتراکگذاری دیپفیکهای جنسی بدون رضایت میتواند ناقض قوانین مربوط به آزار و اذیت، منافی عفت، افترا یا سوءاستفاده مبتنی بر تصویر باشد. اگر هدف یک فرد زیر سن قانونی باشد، حتی اگر با هوش مصنوعی تولید شده باشد، ممکن است بهعنوان محتوای سوءاستفاده جنسی از کودکان تلقی شود.

اگر دیپفیک آشکارا جعلی به نظر برسد، آیا باز هم به حساب آسیب میرسد؟

بله. هدف سوءاستفاده واقعگرایی فنی نیست؛ بلکه تحقیر، ارعاب و کنترل است. حتی یک تصویر کاملاً ساختگی میتواند سلامت روان، روابط و اعتبار یک فرد را خدشهدار کند—بهویژه وقتی توسط کسانی که میخواهند بدترین را باور کنند، از زمینه خارج شود.

آیا میتوانم کاملاً از سوءاستفاده شدن عکسهایم جلوگیری کنم؟

هیچ استراتژی آنلاین صددرصد مطمئن نیست. اما میتوانید با محدود کردن عکسهای باکیفیت بالا در فضای عمومی، استفاده از تنظیمات حریم خصوصی، اجتناب از اپلیکیشنهای مشکوک و واکنش سریع همراه با مستندات و درخواستهای حذف محتوا در صورت وقوع هرگونه مشکل، ریسک و تأثیر آن را بهطور قابلتوجهی کاهش دهید.

آیا باید کلی سلفی گذاشتن را متوقف کنم؟

این یک تصمیم شخصی است. برای اکثر افراد، رویکرد بهتر، پستگذاری هوشمندانه است: حسابهای خصوصی یا فقط برای دوستان، عکسهای تمامتن کمتر، برش بیشتر و احتیاط در انتخاب اپلیکیشنهایی که به آنها اجازه دسترسی به عکسهای دوربین خود را میدهید. ناپدید شدن کامل از اینترنت برای اکثر افراد نه واقعبینانه است و نه ضروری.

چگونه خالقان میتوانند در حالی که از محتوای خود کسب درآمد میکنند، ایمن بمانند؟

سازندگان باید گردش کار خود را در پلتفرمهای مورد اعتماد متمرکز کنند، از تنظیمات حریم خصوصی قوی برای محتوای پشتصحنه یا پولی استفاده کنند و تعداد برنامههای خارجی که به فایلهای خام آنها دسترسی دارند را به حداقل برسانند. انتخاب یک اکوسیستم یکپارچه با بهینهسازی هوش مصنوعی، ابزارهای سازنده و قابلیت درآمدزایی داخلی—بهجای استفاده از خدمات جداگانه و متعدد—احتمال نشت تصاویر به فرایندهای تولید دیپفیک را کاهش میدهد.