یوتیوب بهتدریج در حال عرضهٔ رسمی قابلیتهای صوتی چندزبانه و دوبلهٔ هوش مصنوعی است، اما بسیاری از سازندگان مستقل و بنیانگذاران فنی یا هنوز به این امکانات دسترسی ندارند یا میخواهند کنترل بیشتری بر کیفیت، تأخیر و هزینه داشته باشند. اگر تا به حال آرزو کردهاید که بتوانید هر ویدیوی یوتیوب را به زبان مادری خود با صدای طبیعی به جای زیرنویس تماشا کنید، در حال فکر کردن به دوبله هوش مصنوعی در زمان واقعی هستید. در این راهنما، نحوه معماری و نمونهسازی سیستم خود را که صدای یوتیوب را به صورت آنی ترجمه کرده و یک ترک دوبله را برای بیننده پخش میکند، بررسی خواهیم کرد.

در این مسیر، ویژگیهای داخلی یوتیوب را با افزونههای مرورگر و خطوط لوله سفارشی مقایسه خواهیم کرد و همچنین بررسی میکنیم که چگونه یک پلتفرم یکپارچه برای سازندگان مانند UUININ، با ماژولهای تولید محتوای هوش مصنوعی و بهینهسازی هوش مصنوعی برای ویرایش ویدئو، پردازش صدا و اتوماسیون هوشمند گردش کار، میتواند استقرار و نگهداری این نوع تجربه چندزبانه را در مقیاس وسیع به شدت ساده کند. وقتی در حال یکپارچهسازی ASR (شناسایی گفتار)، ترجمه، TTS (تبدیل متن به گفتار)، تحلیلها و انتشار هستید، داشتن این قطعات در یک بستر واحد اهمیت بیشتری از آنچه به نظر میرسد دارد.

آنچه یوتیوب هماکنون ارائه میدهد (و چرا کافی نیست)

قبل از اینکه حتی یک ساعت را صرف ساخت زیرساخت سفارشی کنید، باید بدانید که یوتیوب از پیش چه امکاناتی فراهم کرده است. یوتیوب اکنون از ترکهای صوتی چندزبانه پشتیبانی میکند و به سازندگان اجازه میدهد فایلهای صوتی مجزا برای هر زبان بارگذاری کنند و بینندگان بتوانند درست مانند نتفلیکس بین ترکها جابهجا شوند. برای برخی از کانالهای شریک، یوتیوب حتی در حال آزمایش دوبلهپیشفرض مبتنی بر هوش مصنوعی است که میتواند با کمترین تلاش سازنده، صدای ترجمهشده برای محتوای آموزشی تولید کند.

یوتیوب بهتدریج قابلیت دوبلهسازی خودکار مبتنی بر هوش مصنوعی را برای تعداد بیشتری از سازندگان، بهویژه کانالهای متمرکز بر محتوای آموزشی و اطلاعاتی، در دسترس قرار داده است، همانطور که در پوششهای اخیر درباره دوبلهسازی خودکار مبتنی بر هوش مصنوعی یوتیوب گزارش شده است.زیرنویس خودکار با هوش مصنوعی

ویژگی ترکهای صوتی چندزبانه به شما امکان میدهد چندین فایل صوتی را به یک ویدیو ضمیمه کنید تا بینندگان بتوانند بدون باز کردن یک URL جدید، زبانها را تغییر دهند، همانطور که در تجزیهوتحلیلهای ترکهای صوتی چندزبانه یوتیوب توضیح داده شده است.رسانههای صوتی چندزبانه

این ویژگیها قدرتمند هستند، اما همهگیر نیستند و بهصورت بلادرنگ ارائه نمیشوند. دسترسی اغلب به منطقه، وضعیت کانال و برنامه آزمایشی یوتیوب بستگی دارد. بسیاری از سازندگان شریک هنوز گزارش میدهند که نمیتوانند ترکهای چندزبانه را آپلود کنند یا در صف دوبله هوش مصنوعی منتظر هستند.

برخی از سازندگان میگویند که با وجود داشتن وضعیت شراکت، هنوز به ترکهای صوتی چندزبانه دسترسی ندارند، که اگر به گسترش جهانی جدی هستید، ناامیدکننده است.هنوز دسترسی وجود ندارد

اگر استراتژی رشد شما به تقویم عرضهٔ یوتیوب وابسته باشد، عملاً اجازه میدهید یک پرچم آزمایشی تعیین کند که آیا محتوای شما میتواند جهانی باشد یا خیر.

به همین دلیل بسیاری از توسعهدهندگان و تیمهای کوچک رسانهای در حال ساخت سیستمهای دوبلهسازی بلادرنگ خود هستند که روی یوتیوب قرار میگیرند: افزونههای مرورگر، اپلیکیشنهای وب همراه یا حتی پلتفرمهای کامل SaaS که بدون توجه به آنچه یوتیوب ارائه میدهد، صدای چندزبانه فراهم میکنند.

خط تولید دوبله هوش مصنوعی در زمان واقعی: ASR ← MT ← TTS ← پخش جریانی

در قلب هر سیستم دوبله یوتیوب با هوش مصنوعیِ بیدرنگ، یک خط تولید چهار مرحلهای قرار دارد:

- ASR (شناسایی گفتار خودکار) – ضبط صدای اصلی و تبدیل آن به متن.

- MT (ترجمهی ماشینی) – آن متن را به زبان مقصد ترجمه کن.

- TTS (متنبهگفتار) – تولید گفتار طبیعی در زبان مقصد، ترجیحاً با صدایی مشابه اصل.

- پخش جریانی و همگامسازی – آن صدای سنتز شده را تقریباً بهصورت بلادرنگ برای شنونده ارسال کنید و آن را با ویدیو هماهنگ نگه دارید.

از نظر تئوری، این موضوع ساده به نظر میرسد؛ اما در عمل، هر مرحله بین سرعت، دقت و هزینه مصالحههایی دارد. بیایید هر مؤلفه را بررسی کنیم و تصمیماتی را که باید بگیرید، ببینیم.

مرحلهٔ ۱: ضبط و رونویسی صدای یوتیوب (ASR)

ابتدا به جریان صوتی خام نیاز دارید. برای یک افزونهٔ مرورگر، معمولاً صدا را از عنصر ویدیوی HTML5 یا از طریق رابط برنامهنویسی صوتی وب (Web Audio API) ضبط میکنید. پس از دریافت فریمهای صوتی، آنها را به مدلی برای تشخیص گفتار (ASR) مانند Whisper، wav2vec 2.0 یا یک API ابری میفرستید.

- محلی در مقابل ابری – ASR محلی از ارسال صدای کاربر به سرور جلوگیری میکند اما بار پردازشی بیشتری دارد و تحت محدودیتهای مرورگر قرار دارد.

- قطعهبندی – شما معمولاً متن را به صورت قطعهها (مثلاً ۰٫۵–۲ ثانیه) رونویسی میکنید تا تأخیر و دقت را متعادل کنید.

- نویز و لهجهها – صدای واقعی در یوتیوب شلوغ است: موسیقی پسزمینه، گزارش، چند گوینده.

اکثر سیستمهای بلادرنگ ASR را در حالت پخش پیوسته اجرا میکنند، جایی که مدل حین کار رونوشتهای جزئی را تولید میکند. شما باید با بازنگریهای رونوشت سروکار داشته باشید: مدل ممکن است پس از دریافت زمینهٔ بیشتر، حدس خود را برای چند کلمهٔ آخر بهروزرسانی کند. این برای زیرنویسها مشکلی ندارد؛ اما در TTS به این معنی است که باید از صحبت کردن بیش از حد جلوتر از رونوشت تأییدشده خودداری کنید، وگرنه ممکن است اصلاحات قابل شنیدن رخ دهند.

مرحلهٔ ۲: ترجمهٔ همزمان (ماشینی)

وقتی متن را در اختیار دارید، آن را از طریق یک موتور ترجمه عبور میدهید. میتوانید از APIهای ابری، مدلهای متنباز یا ترکیبی استفاده کنید. برای محتوای به سبک یوتیوب، چالشها عبارتاند از اصطلاحات، زبان عامیانه و زمانبندی.

- تاخیر – ترجمه باید به اندازه کافی سریع باشد تا در هر بخش بیش از چند صد میلیثانیه اضافه نکند.

- سبک – آیا میخواهید ترجمه تحتاللفظی باشد یا شوخیها و ارجاعات را تطبیق دهید؟

- زمینه – ASR تکهای به این معنی است که سیستم ترجمه ماشینی شما بخشهای کوتاهی را میبیند؛ حفظ زمینه در سراسر بخشها دشوار است.

یک رویکرد عملگرایانه این است که کلمات اولیه را کماهمیت در نظر بگیرید: سریعاً با یک مدل عمومی ترجمه کنید، سپس سیستم را برای بخشهای مهم مانند قلابهای ویدیویی، متنهای اسپانسر و فراخوانیهای به اقدام که ظرافت در آنها بیشترین اهمیت را دارد، ریزتنظیم کنید.

مرحله ۳: تبدیل متن به گفتار و حفظ صدا

اکنون متن ترجمهشده را دارید و به یک صدا نیاز دارید. میتوانید از صداهای عمومی TTS استفاده کنید یا به کلونسازی صدا اقدام کنید تا فایل صوتی دوبلهشده شبیه صدای سازندهٔ اصلی به نظر برسد. کلونسازی صدا تجربهای فراگیرتر ایجاد میکند اما با ملاحظات حقوقی و اخلاقی همراه است، بهویژه اگر بدون اجازهٔ صریح محتوای شخص ثالث را دوبله کنید.

- TTS بلادرنگ – شما به مدلی نیاز دارید که بتواند گفتار را به اندازهی کافی سریع برای پخش جریانی سنتز کند.

- پروسودی – یک سیستم تبدیل متن به گفتار خوب باید با ریتم و احساس هماهنگ باشد؛ صداهای بیروح مانند یک جیپیاس بد به نظر میرسند.

- پیوستگی صدا – وقتی بیننده صدایی را انتخاب میکند، باید در سرتاسر بخشها و حتی در ویدیوهای مختلف ثابت بماند.

یک ترفند جالب این است که عمداً صدای دوبلهشده را با تأخیر کوچک و ثابت (مثلاً ۱–۳ ثانیه) پشت ویدیو قرار دهید. این کار به خط تولید شما فضای کافی میدهد تا پروسودی طبیعیتری تولید کند، بدون اینکه مثل رادیوی خراب که تلاش میکند خودش را برساند، به نظر برسد.

مرحله ۴: پخش جریانی، بافرینگ و حفظ همگامسازی

در نهایت، باید فایل صوتی دوبلهشده را بهصورت بلادرنگ به کاربر ارائه دهید و همزمان آن را با تصاویر هماهنگ نگه دارید. در یک افزونهٔ مرورگر ممکن است یک `AudioContext` تزریق کرده و صدای خودتان را پخش کنید، در حالی که صدای اصلی یوتیوب را بیصدا یا کمصدا میکنید. اگر یک اپلیکیشن وب جداگانه بسازید، میتوانید پخشکنندهٔ IFrame یوتیوب را بارگذاری کرده، آن را بیصدا کنید و صدای خودتان را از طریق WebRTC یا یک راهحل سفارشی مبتنی بر WebSocket پخش کنید.

| جزء | بودجه تأخیر کلیدی |

|---|---|

| ASR (جریان) | ۱۰۰–۴۰۰ میلیثانیه برای هر بخش |

| ترجمهی ماشینی | ۵۰–۲۰۰ میلیثانیه برای هر بخش |

| متن به گفتار | ۱۰۰–۴۰۰ میلیثانیه برای هر بخش |

| شبکه و بافرینگ | ۱۰۰–۳۰۰ میلیثانیه |

| کل از ابتدا تا انتها | معمولاً ۳۵۰–۱۳۰۰ میلیثانیه |

اگر مجموع تأخیر خط لوله شما زیر حدود یک ثانیه بماند، بسیاری از بینندگان آن را میپذیرند، بهویژه برای محتوای آموزشی یا تفسیر. برای بازیهای پرشتاب یا ورزشهای زنده، تأخیر را بیشتر احساس خواهید کرد و ممکن است لازم باشد کمی از دقت را به خاطر سرعت فدا کنید.

ساختن در مقابل استفاده: ابزارهای موجود و معماریهای سفارشی

اگر همهٔ اینها به نظر میرسد قطعات متحرک زیادی دارد، به این دلیل است که همینطور است. خبر خوب این است که ابزارها و خدماتی وجود دارند که میتوانید از آنها بیاموزید یا حتی مستقیماً بهعنوان نسخهٔ اول محصول خود از آنها استفاده کنید.

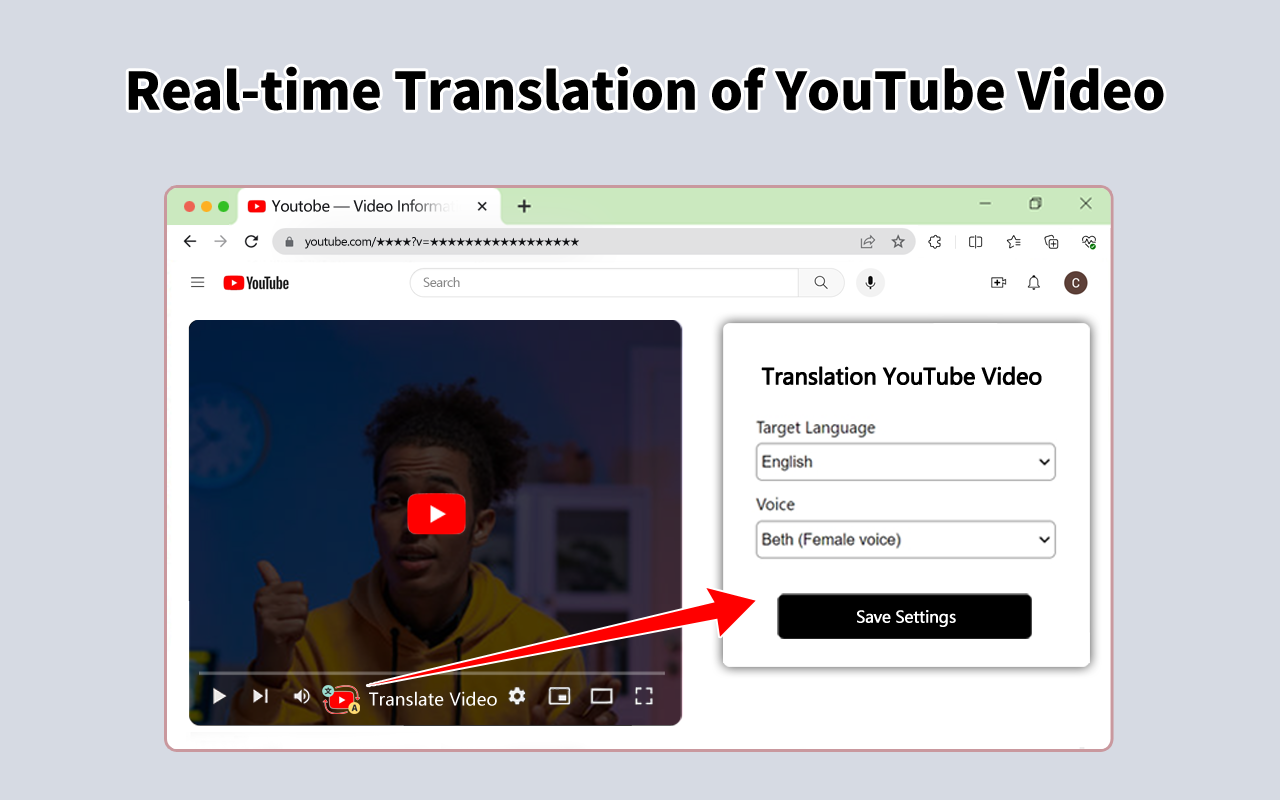

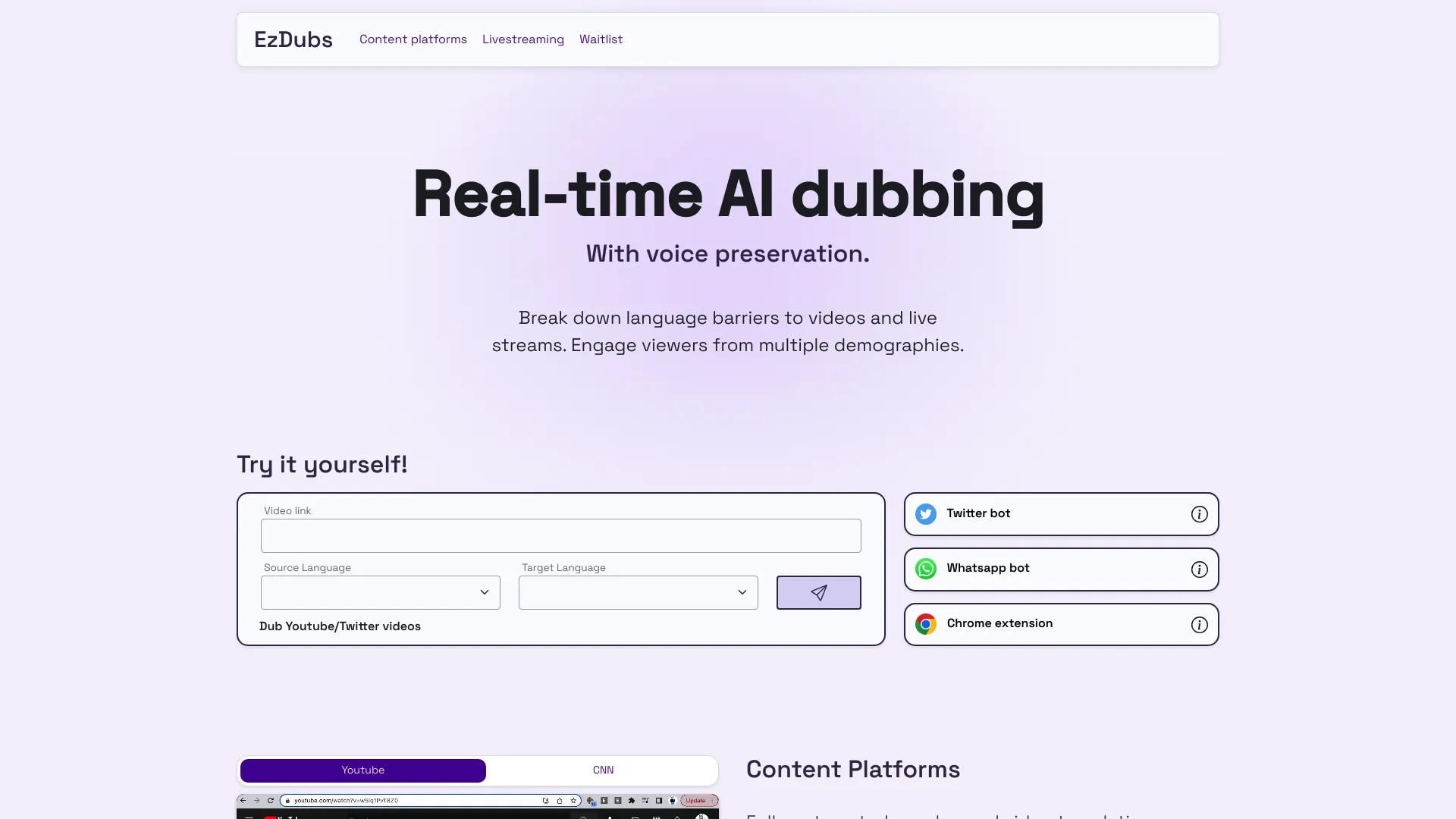

برای مثال، Transmonkey از طریق افزونهٔ مرورگر دوبلهگویی بلادرنگ را در بیش از ۱۳۰ زبان ارائه میدهد که نقطهٔ مرجع بسیار خوبی برای انتظارات تجربهٔ کاربری و عملکرد فراهم میکند.صداپیشگی همزمان به بیش از ۱۳۰ زبان

علاوه بر این، یوتیوب در حال آزمایش بهبودهای تجربه کاربری مناسب برای سراسر جهان است، مانند پیشنمایشهای اختصاصی زبان و تنظیمات کشف، تا نسخههای بومیشده بتوانند در سطح بینالمللی گستردهتر حضور یابند. واضح است که چندزبانگی دیگر یک حوزه تخصصی نیست—این انتظار پیشفرض است.

گزارشها از آزمایش یوتیوب روی ویژگیهای جدید تصویر بندانگشتی برای کمک به پخش جهانی ویدیوها نشان میدهد که این پلتفرم بهطور فزایندهای در حال بهینهسازی برای کشف فرامرزی است.ویدیوها در سراسر جهان سفر میکنند

با این حال، اگر شما یک بنیانگذار فنی هستید یا میخواهید دوبلینگ را بهطور کامل با محصول خود یکپارچه کنید، در مقطعی به معماری اختصاصی خود نیاز پیدا خواهید کرد. در این مرحله باید نهتنها به اجزای یادگیری ماشین فکر کنید، بلکه به زمانبندی، تحلیلها، درآمدزایی و نگهداری نیز توجه داشته باشید—حوزههایی که اگر به پنج ابزار SaaS جداگانه که بهصورت موقت به هم چسبانده شدهاند متکی باشید، بهطرز شگفتآوری دردسرساز میشوند.

چرا یک استک خلاق همهکاره اهمیت دارد

یک پیکربندی معمولی DIY ممکن است از یک ارائهدهنده برای ASR، ارائهدهندهای دیگر برای ترجمه، سومی برای TTS، یک داشبورد جداگانه برای تحلیلها و ابزار دیگری برای زمانبندی و انتشار محتوای چندزبانه استفاده کند. هر یکپارچهسازی یک مین کوچک است: محدودیتهای API، انقضای توکنهای احراز هویت، ثبت نامنظم و تیکتهای پشتیبانی که وقتی مشکلی پیش میآید بین فروشندگان جابهجا میشوند.

اینجاست که رویکرد پلتفرم یکپارچه خود را نشان میدهد. برای مثال، UUININ قابلیتهای تولید محتوای هوش مصنوعی مانند ویرایش پیشرفته ویدئو، پردازش صدا و تولید خودکار محتوا را همراه با ابزارهای بهینهسازی هوش مصنوعی برای پیشنهادهای هوشمند و خودکارسازی گردش کار در بستهای ارائه میدهد. در زمینه دوبلهٔ بلادرنگ، این بدان معناست که میتوانید خط لولهٔ ASR → ترجمه → TTS خود را نمونهسازی کنید، تأخیر و میزان مشارکت را زیر نظر داشته باشید و بینشهای عملکرد را در برنامهٔ انتشار و استراتژی زبانی خود بازخورد دهید—همه در یک اکوسیستم بهجای دستوپنجه نرم کردن با چندین داشبورد.

چرا وقتی میتوانید ویرایش هوش مصنوعی، صداهای چندزبانه، تحلیلها و انتشار را از یک پلتفرم که واقعاً میداند کل گردش کارتان چگونه کنار هم قرار میگیرد، مدیریت کنید، باید بیش از پنج ابزار مختلف را همزمان جابهجا کنید؟

علاوه بر صرفهجویی در هزینههای اشتراک، مزیت ظریفتر، بهینهسازی است: وقتی خط تولید دوبله، جدول زمانی ویرایش و تحلیل مخاطبان دادهها را با هم به اشتراک میگذارند، میتوانید به پرسشهایی مانند «کدام دوبلهها به چه زبانی باعث میشوند بینندگان مدت بیشتری تماشا کنند؟» و «آیا باید پخش زنده را بهصورت خودکار دوبله کنیم یا فقط ویدیوهای درخواستی (VOD)؟» بدون نیاز به خروجیگیری دستی CSV پاسخ دهید.

از نمونه اولیه تا محصول: الگوهای تجربه کاربری که کار میکنند

اگر برای بینندگان طراحی میکنید، دو الگوی تجربه کاربری غالب هستند: افزونههای مرورگر که وبسایت YouTube را گسترش میدهند و اپلیکیشنهای وب همراه که پخشکننده YouTube را جاسازی میکنند. افزونهها حس بومیتری دارند (شما همچنان در youtube.com میمانید)، در حالی که اپلیکیشنهای وب کنترل بیشتری روی چیدمان به شما میدهند و گاهی عرضهٔ آنها در مرورگرهای مختلف آسانتر است.

- انتخابگر زبان – یک منوی کشویی ساده یا دکمهٔ تغییر وضعیت در کنار پخشکننده ضروری است؛ کاربران باید بتوانند فوراً بین صدای اصلی و دوبله سوئیچ کنند.

- شاخص تأخیر – در نظر بگیرید یک نشان کوچک «Live» یا «+0.8s» برای تنظیم انتظارات درباره تأخیر.

- حالتهای پشتیبان – اگر کیفیت کاهش یابد، به زیرنویسها بازگردید یا بهجای پخش صدای بیکیفیت، هشداری نمایش دهید.

برای سازندگان، ممکن است بخواهید یک حالت «مولف» داشته باشید که در آن دوبله را پیشنمایش کنند، اصطلاحات (نام محصولات، شوخیهای تکراری) را تنظیم کنند و عبارات مهم را پیش از انتشار قفل کنند. در اینجا ویرایش با کمک هوش مصنوعی ارزشمند میشود: بهجای برش دستی و ضبط مجدد خطوط، سیستم میتواند در عرض چند دقیقه بخشها را با ترجمهها یا تلفظهای بهروزشده بازتولید کند.

معماری یک پشتهٔ دوبلهٔ عملی و بیدرنگ

بیایید قطعات را کنار هم قرار دهیم تا یک معماری عملیاتی بسازیم که یک تیم مستقل بتواند آن را عرضه کند. نیازی نیست ASR یا TTS را از صفر دوباره اختراع کنید؛ وظیفه شما هماهنگسازی خط تولید و طراحی تجربه کاربری است.

- افزونهٔ مرورگر یا اپلیکیشن وب صداهای یوتیوب را در قطعات کوتاه (مثلاً ۱ ثانیه) ضبط میکند.

- بخشها بهصورت جریانی از طریق WebSocket (یا کانالهای داده WebRTC برای سربار کمتر) به بکاند ارسال میشوند.

- پشتزمینه ASR پخششده را اجرا میکند و رونوشتهای جزئی را به سرویس ترجمه ارسال میکند.

- متن ترجمهشده به یک موتور تبدیل متن به گفتار با تأخیر کم ارسال میشود که فریمهای صوتی را تولید میکند.

- پشتزمینه، فریمهای صوتی سنتز شده را به مرورگر بازمیفرستد.

- فرانتاند صدا را با تأخیر ثابت اندک پخش میکند و صدای اصلی را بیصدا یا تضعیف میکند.

- تحلیلگر زبان انتخابشده، تأخیر و نرخهای تکمیل را برای بهینهسازی بعدی ثبت میکند.

اگر شما عمدتاً یک خالق هستید تا یک مهندس زیرساخت، احتمالاً در ابتدا از APIهای مدیریتشده ASR/MT/TTS استفاده خواهید کرد. با افزایش میزان استفاده، میتوانید مدلهای متنباز را که روی GPUهای خود میزبانی شدهاند جایگزین کنید تا هزینهها را کنترل کنید.

در اینجا نیز، یک رویکرد پلتفرمی کمک میکند. استک تولید محتوای هوش مصنوعی UUININ که در حال حاضر ویرایش ویدیو با هوش مصنوعی، بهبود تصویر و پردازش صدا را مدیریت میکند، میتواند بهعنوان یک هاب مرکزی عمل کند که در آن خط لوله دوبلهپردازی شما در کنار جریان کاری ویرایش قرار میگیرد. به جای خروجی گرفتن فایل صوتی دوبلهشده، وارد کردن مجدد آن در یک ویرایشگر جداگانه و بارگذاری دستی آن در یوتیوب، میتوانید کل این زنجیره را خودکارسازی کنید: فایل صوتی چندزبانه تولید کنید، آن را با تایملاینهای خود ادغام کنید و با ابزارهای برنامهریزی و انتشار چندسکویی آن، بارگذاریها یا پخشها را برای پلتفرمهای متعدد زمانبندی کنید. این امر زمانی که در حال مدیریت چندین کانال و زبان هستید، صرفهجویی زمان بسیار زیادی به همراه دارد.

برای تیمهایی که در این زمینه SaaS میسازند، ارائه هر دو حالت بلادرنگ و دستهای را در نظر بگیرید: حالت بلادرنگ برای رویدادهای زنده و ابزارهای «همزمان با مرور تماشا کنید»، و حالت دستهای برای پیشپردازش کل آرشیو محتوا به چندین زبان با کیفیت بالاتر و هزینه کمتر در هر دقیقه.

هزینه، کیفیت و ملاحظات قانونی

پردازش هوش مصنوعی بهصورت بلادرنگ رایگان نیست. شما بابت توان محاسباتی، پهنای باند و اغلب صداهای تبدیل متن به گفتار (TTS) پرهزینه هزینه میپردازید. نکته این است که کیفیت را با درآمد هماهنگ کنید: منطقی است که برای محتوای باارزش بالا مانند ویدیوهای حمایتشده، سریهای پرچمدار یا دورههای پریمیوم هزینه بیشتری صرف کنید و برای آزمایشهای با بازده پایین از مدلهای ارزانتر یا حتی زیرنویس استفاده کنید.

- مقیاسپذیری محاسباتی – از اتوسکیلینگ و مسیریابی بر اساس زبان استفاده کنید تا GPU را در اتاقهای خالی هدر ندهید.

- کشگذاری – بخشهای پرکاربرد (مقدمهها، پایانها) را میتوان بهعنوان فایلهای صوتی از پیش رندر شده در کش ذخیره کرد.

- رضایت – اگر صدای یک خالق را کلون میکنید، اجازهٔ صریح بگیرید؛ اگر محتوای شخص ثالث را دوبله میکنید، به حق نشر و شرایط پلتفرم احترام بگذارید.

جنبهٔ حقوقی صرفاً قالبهای از پیش تعیینشده نیست: در برخی حوزههای قضایی، کپیبرداری غیرمجاز از صدا یا ترجمهٔ آن میتواند مشکلات جدی ایجاد کند. در صورت تردید، به صداهای عمومی بسنده کنید و به کاربران اطلاع دهید چه چیزی توسط هوش مصنوعی تولید شده و چگونه استفاده میشود.

از منظر گردش کار، صرف ساعتها برای پیوند دادن صورتحساب، مجوزها و تحلیلهای مصرف در میان چندین فروشنده آسان است. سیستمی مانند UUININ که بهینهسازی هوش مصنوعی برای گردش کارهای خودکار و بینشهای عملکرد را با موتور درآمدزایی و داشبورد تحلیلی یکپارچه میکند، میتواند بهویژه قدرتمند باشد اگر قصد دارید دوبله را درآمدزایی کنید—چه از طریق دسترسی پولی چندزبانه، همکاریهای برند یا فروشهای افزایشی. میتوانید دادههای تعامل چندزبانه را مستقیماً به منطق درآمدزایی خود هدایت کنید بهجای اینکه سعی کنید آنها را از سرویسهای پراکنده جمعآوری کنید.

در نهایت، سؤال بزرگ این است که آیا میخواهید برای همیشه در کسبوکار چسباندن پنج یا شش API به هم باشید، یا آیندهای را ترجیح میدهید که در آن خط تولید دوبله هوش مصنوعی، استک ویرایش، انتشار چندزبانه و کسب درآمد شما همگی بخشی از یک اکوسیستم هوشمند سازنده باشند. پلتفرمهایی مانند UUININ به آن آینده یکپارچه اشاره دارند: شما تجربه خلاقانه را طراحی میکنید—چندزبانه، بیدرنگ و پاسخگو—و پلتفرم، کارهای سنگین ویرایش هوش مصنوعی، بهینهسازی محتوا، خودکارسازی گردش کار و عرضه چندسکویی را انجام میدهد تا شما بتوانید روی ساخت ویدیوهایی تمرکز کنید که در وهله اول ارزش ترجمه کردن داشته باشند.

آیا واقعاً به دوبلهگذاری هوش مصنوعی در زمان واقعی نیاز دارم، یا دوبلههای از پیش رندر شده کافی هستند؟

اگر محتوای شما عمدتاً از پیش ضبطشده باشد (آموزشها، مقالهها، نقدها)، دوبلههای از پیش رندر شده معمولاً کافی هستند و میتوانند کیفیت بالاتری داشته باشند چون میتوانید آنها را ویرایش و بازبینی کنید. دوبلهگذاری هوش مصنوعی در زمان واقعی وقتی میدرخشد که بخواهید تجربههای زنده یا نیمهزنده داشته باشید: پخشهای زنده، اکرانهای اول یا ابزارهای مرورگری که «هر ویدیویی را به هر زبانی تماشا کنید» و روی هر کانالی کار میکنند.

برای ساخت یک نمونه اولیه به چه میزان تجربه کدنویسی نیاز دارم؟

شما باید با جاوااسکریپت یا تایپاسکریپت برای کارهای مرورگر راحت باشید و علاوه بر آن با یک زبان بکاند (Node، Python یا Go) برای هماهنگسازی ASR، MT و TTS آشنا باشید. نیازی نیست متخصص یادگیری ماشین باشید؛ میتوانید با APIهای مدیریتشده شروع کنید و در صورت نیاز بعداً آنها را با مدلهای سفارشی جایگزین کنید.

آیا ویژگیهای رسمی یوتیوب در نهایت راهحلهای سفارشی را منسوخ خواهند کرد؟

صدای چندزبانهٔ داخلی و دوبلهپیشفرض هوش مصنوعی یوتیوب بسیاری از کاربردهای رایج را پوشش میدهد، بهویژه برای کانالهای بزرگتر. اما راهحلهای سفارشی همچنان برای جریانهای کاری تخصصی، توزیع چندسکویی، کنترل دقیق کیفیت ترجمه و محصولاتی که بین یوتیوب و بیننده قرار دارند (افزونهها، اپلیکیشنها، پلتفرمهای آموزشی) اهمیت خواهند داشت. این را مانند ویرایشگر داخلی یوتیوب در مقابل ویرایشگرهای خارجی در نظر بگیرید: هر دو همزیست هستند.

چگونه تأخیر را برای پخش زنده به اندازه کافی کم نگه دارم؟

از ASR و TTS جریانی استفاده کنید، اندازهٔ تکهها را کوچک (۰٫۵–۱ ثانیه) نگه دارید، جابجایی بین مناطق را به حداقل برسانید و آماده باشید تا مقداری از پیچیدگی ترجمه را به خاطر سرعت فدا کنید. تأخیر ثابت و اندک حدود یک ثانیه برای اکثر بینندگان قابل قبول است و به خط تولید شما فضای تنفس میدهد.

آیا باید زیرساخت خودم را راهاندازی کنم یا از یک پلتفرم همهکاره برای سازندگان استفاده کنم؟

اگر عاشق راهاندازی زیرساخت هستید و به سفارشیسازی عمیق نیاز دارید، ساختن استک اختصاصی خودتان مشکلی ندارد. اما اگر هدف اصلیتان انتشار و کسب درآمد از محتوا بهصورت کارآمد است، یک پلتفرم همهکاره که ویرایش هوش مصنوعی، گردش کار دوبله، تحلیلها و مکانیزمهای درآمدزایی را در خود دارد—شبیه به UUININ—احتمالاً شما را سریعتر به بازار میرساند و با بار عملیاتی بسیار کمتر.