يطرح YouTube ببطء ميزات الدبلجة الصوتية الرسمية متعددة اللغات والذكاء الاصطناعي بلغات متعددة، ولكن العديد من المبدعين المستقلين والمؤسسين التقنيين إما أنهم لا يستطيعون الوصول إليها بعد أو يريدون المزيد من التحكم في الجودة ووقت الاستجابة والتكلفة. إذا كنت تتمنى أن تشاهد أي مقطع فيديو على YouTube بلغتك الأم مع صوت طبيعي بدلاً من الترجمة، فأنت تفكر في الدبلجة بالذكاء الاصطناعي في الوقت الفعلي. في هذا الدليل، سوف نتعرف في هذا الدليل على كيفية تصميم نظامك الخاص الذي يترجم صوت YouTube على الفور ويبث مسارًا مدبلجًا إلى المشاهد.

سنقوم على طول الطريق بمقارنة ميزات YouTube المدمجة مع ملحقات المتصفح وخطوط الأنابيب المخصصة، وسننظر أيضًا في كيفية قيام منصة منشئي المحتوى الموحّدة مثل UUININ، مع وحدات إنشاء محتوى الذكاء الاصطناعي وتحسين الذكاء الاصطناعي لتحرير الفيديو ومعالجة الصوت وأتمتة سير العمل الذكية، بتبسيط نشر هذا النوع من التجارب متعددة اللغات على نطاق واسع والحفاظ عليها بشكل كبير. عندما تقوم بتجميع كل من ASR، والترجمة، وخدمات الترجمة الفورية وترجمة النص، والتحليلات، والنشر، فإن وجود هذه الأجزاء تحت سقف واحد أمر مهم أكثر مما يبدو.

ما يقدمه YouTube بالفعل (ولماذا لا يكفي)

قبل أن تقضي ساعة واحدة في إنشاء بنية تحتية مخصصة، يجب أن تفهم ما يوفره YouTube بالفعل. يدعم YouTube الآن المسارات الصوتية متعددة اللغات، مما يسمح لمنشئي المحتوى بتحميل ملفات صوتية بلغات منفصلة والسماح للمشاهدين بتبديل المسارات كما هو الحال على Netflix. بالنسبة لبعض القنوات الشريكة، يختبر YouTube حتى الدبلجة التلقائية المدعومة بالذكاء الاصطناعي التي يمكنها إنشاء صوت مترجم لمحتوى على غرار المحتوى المعرفي بأقل جهد ممكن من المبدعين.

بدأ YouTube تدريجيًا في طرح الدبلجة التلقائية المدعومة بالذكاء الاصطناعي للمزيد من منشئي المحتوى، وخاصة القنوات التي تركز على المحتوى التعليمي والمعلوماتي، كما ورد في التغطية الأخيرة للدبلجة التلقائية المدعومة بالذكاء الاصطناعي على YouTube.دبلجة تلقائية مدعومة بالذكاء الاصطناعي

تسمح لك ميزة المسارات الصوتية متعددة اللغات بإرفاق ملفات صوتية متعددة اللغات بفيديو واحد، بحيث يمكن للمشاهدين التبديل بين اللغات دون فتح عنوان URL جديد، كما هو مفصّل في تفاصيل المسارات الصوتية متعددة اللغات على YouTube.مسارات صوتية متعددة اللغات

هذه الميزات قوية، لكنها ليست عالمية وليست في الوقت الحقيقي. غالبًا ما يعتمد الوصول إليها على المنطقة وحالة القناة وجدول تجارب YouTube. لا يزال العديد من منشئي المحتوى الشركاء يبلغون عن عدم قدرتهم على تحميل مسارات متعددة اللغات أو انتظارهم في طابور الدبلجة بالذكاء الاصطناعي.

يصف بعض منشئي المحتوى أنهم لا يزالون غير قادرين على الوصول إلى مسارات صوتية متعددة اللغات على الرغم من كونهم شركاء، وهو أمر محبط إذا كنت جاداً في الوصول إلى العالمية.لا يوجد وصول حتى الآن

إذا كانت استراتيجية النمو الخاصة بك تعتمد على تقويم طرح يوتيوب، فأنت في الواقع تترك علم التجربة يقرر ما إذا كان المحتوى الخاص بك يمكن أن يكون عالميًا أم لا.

لهذا السبب يقوم العديد من المطورين وفرق الوسائط الصغيرة ببناء أنظمة الدبلجة الفورية الخاصة بهم التي توضع فوق YouTube: ملحقات المتصفح أو تطبيقات الويب المصاحبة أو حتى منصات SaaS كاملة توفر صوتًا متعدد اللغات بغض النظر عما يعرضه YouTube.

خط أنابيب الدبلجة بالذكاء الاصطناعي في الوقت الحقيقي: ASR → MT → TTS → البث المباشر

يوجد في قلب أي نظام دبلجة يوتيوب بالذكاء الاصطناعي في الوقت الفعلي خط أنابيب من أربع مراحل:

- ASR (التعرف التلقائي على الكلام) - التقاط الصوت الأصلي وتحويله إلى نص.

- الترجمة الآلية (الترجمة الآلية) - ترجمة ذلك النص إلى اللغة الهدف.

- TTS (تحويل النص إلى كلام) - توليف الكلام الطبيعي باللغة الهدف، ومن الناحية المثالية بصوت مشابه للصوت الأصلي.

- البث والمزامنة - إرسال هذا الصوت المركب إلى المستمع في الوقت الفعلي تقريبًا، مع الحفاظ على مواءمته مع الفيديو.

من الناحية النظرية، يبدو هذا الأمر واضحًا ومباشرًا؛ ولكن من الناحية العملية، فإن كل مرحلة لها مفاضلات بين السرعة والدقة والتكلفة. دعنا نستعرض كل عنصر والقرارات التي سيتعين عليك اتخاذها.

المرحلة 1: التقاط صوت اليوتيوب ونسخه (ASR)

أولاً، تحتاج إلى دفق الصوت الخام. بالنسبة لملحق المتصفح، عادةً ما تلتقط الصوت من عنصر فيديو HTML5 أو عبر واجهة برمجة تطبيقات صوت الويب. بمجرد حصولك على إطارات الصوت، تقوم بتلقيمها في نموذج ASR مثل Whisper أو wav2vec 2.0 أو واجهة برمجة تطبيقات سحابية.

- على الجهاز مقابل السحابة - يتجنب ASR على الجهاز بث صوت المستخدم إلى الخادم ولكنه أكثر ثقلاً على وحدة المعالجة المركزية ومحدود بسبب قيود المتصفح.

- التقطيع - عادةً ما تقوم بالنسخ في أجزاء (على سبيل المثال، 0.5-2 ثانية) لتحقيق التوازن بين زمن الاستجابة والدقة.

- الضوضاء واللكنات - الصوت في العالم الحقيقي على YouTube فوضوي: موسيقى في الخلفية، تعليق، مكبرات صوت متعددة.

تقوم معظم أنظمة الوقت الحقيقي بتشغيل ASR في وضع التدفق، حيث يقوم النموذج بإصدار نصوص جزئية أثناء عمله. ستحتاج إلى التعامل مع مراجعات النصوص: قد يقوم النموذج بتحديث تخمينه للكلمات القليلة الأخيرة بمجرد سماعه المزيد من السياق. لا بأس بذلك بالنسبة للترجمات؛ أما بالنسبة لتحويل النص إلى نص، فهذا يعني أنه يجب عليك تجنب التحدث قبل النص المؤكد بكثير وإلا فإنك تخاطر بإجراء تصحيحات مسموعة.

المرحلة 2: الترجمة الفورية (الترجمة الآلية)

بمجرد حصولك على النص، تقوم بإرساله من خلال محرك ترجمة. يمكنك استخدام واجهات برمجة التطبيقات السحابية، أو النماذج مفتوحة المصدر، أو مزيج من هذه النماذج. بالنسبة للمحتوى على غرار YouTube، تتمثل التحديات في المصطلحات، واللغة العامية، والتوقيت.

- الكمون - يجب أن تكون الترجمة سريعة بما يكفي لعدم إضافة أكثر من بضع مئات من المللي ثانية لكل قطعة.

- الأسلوب - هل تريد الترجمة الحرفية أم تكييف النكات والإشارات؟

- السياق - يعني ASR المجزأ أن نظام الترجمة الآلية الخاص بك يرى مقاطع قصيرة؛ لذا فإن الحفاظ على السياق عبر المقاطع أمر صعب.

يتمثل أحد الأساليب العملية في التعامل مع الكلمات المبكرة على أنها منخفضة المخاطر: تترجم بسرعة باستخدام نموذج عام، ثم تقوم بضبط النظام للمقاطع ذات الأهمية العالية مثل مقاطع الفيديو، وقراءات الرعاة والدعوات إلى العمل حيث يكون الفارق الدقيق أكثر أهمية.

المرحلة 3: تحويل النص إلى كلام وحفظ الصوت

الآن لديك نص مترجم وتحتاج إلى صوت. يمكنك إما استخدام أصوات TTS عامة أو محاولة استنساخ الصوت بحيث يبدو الصوت المدبلج مثل المبدع الأصلي. يعد استنساخ الصوت أكثر غامرة ولكنه يأتي مع اعتبارات قانونية وأخلاقية، خاصة إذا كنت تقوم بدبلجة محتوى طرف ثالث دون إذن صريح.

- TTS في الوقت الحقيقي - تحتاج إلى نموذج يمكنه توليف الكلام بسرعة كافية للبث.

- النغمة - يجب أن تتطابق الترجمة الفورية للألفاظ الجيدة مع الإيقاع والعاطفة؛ فالأصوات المسطحة ستبدو وكأنها نظام تحديد المواقع السيئ.

- اتساق الصوت - بمجرد أن يختار المشاهد صوتًا ما، يجب أن يظل ثابتًا عبر المقاطع وحتى عبر مقاطع الفيديو.

الحيلة الأنيقة هي تأخير الصوت المدبلج عن قصد بتأخير صغير وثابت (على سبيل المثال، 1-3 ثوانٍ) خلف الفيديو. يمنح ذلك خط الأنابيب الخاص بك مساحة كافية لالتقاط الأنفاس لتوليد المزيد من الإيقاع الطبيعي دون أن يبدو وكأنه راديو معطل يحاول اللحاق بالركب.

المرحلة 4: البث والتخزين المؤقت والحفاظ على المزامنة

أخيرًا، تحتاج إلى توصيل الصوت المدبلج إلى المستخدم في الوقت الفعلي مع الحفاظ على توافقه مع المرئيات. في ملحق المتصفح، يمكنك حقن "سياق صوتي" وتشغيل المسار الصوتي الخاص بك أثناء كتم صوت YouTube الأصلي أو كتمه. إذا قمت بإنشاء تطبيق ويب منفصل، يمكنك تحميل مشغل YouTube IFrame وكتم صوته وبث الصوت الخاص بك عبر WebRTC أو حل مخصص قائم على WebSocket.

| المكوّن | ميزانية الكمون الرئيسية |

|---|---|

| ASR (بث مباشر) | 100-400 مللي ثانية لكل قطعة |

| الترجمة الآلية | 50-200 مللي ثانية لكل قطعة |

| تحويل النص إلى كلام | 100-400 مللي ثانية لكل قطعة |

| الشبكة والتخزين المؤقت | 100-300 مللي ثانية |

| إجمالي النهاية إلى النهاية | 350-1,300 مللي ثانية نموذجي |

إذا ظل إجمالي التأخير في خط الأنابيب أقل من ثانية واحدة تقريبًا، فسيتقبله العديد من المشاهدين، خاصة للمحتوى التعليمي أو التعليق. أما بالنسبة للألعاب السريعة أو الرياضات المباشرة، فستشعر بالتأخير أكثر، وقد تحتاج إلى مقايضة بعض الدقة بالسرعة.

البناء مقابل الاستخدام: الأدوات الموجودة والبنى المخصصة

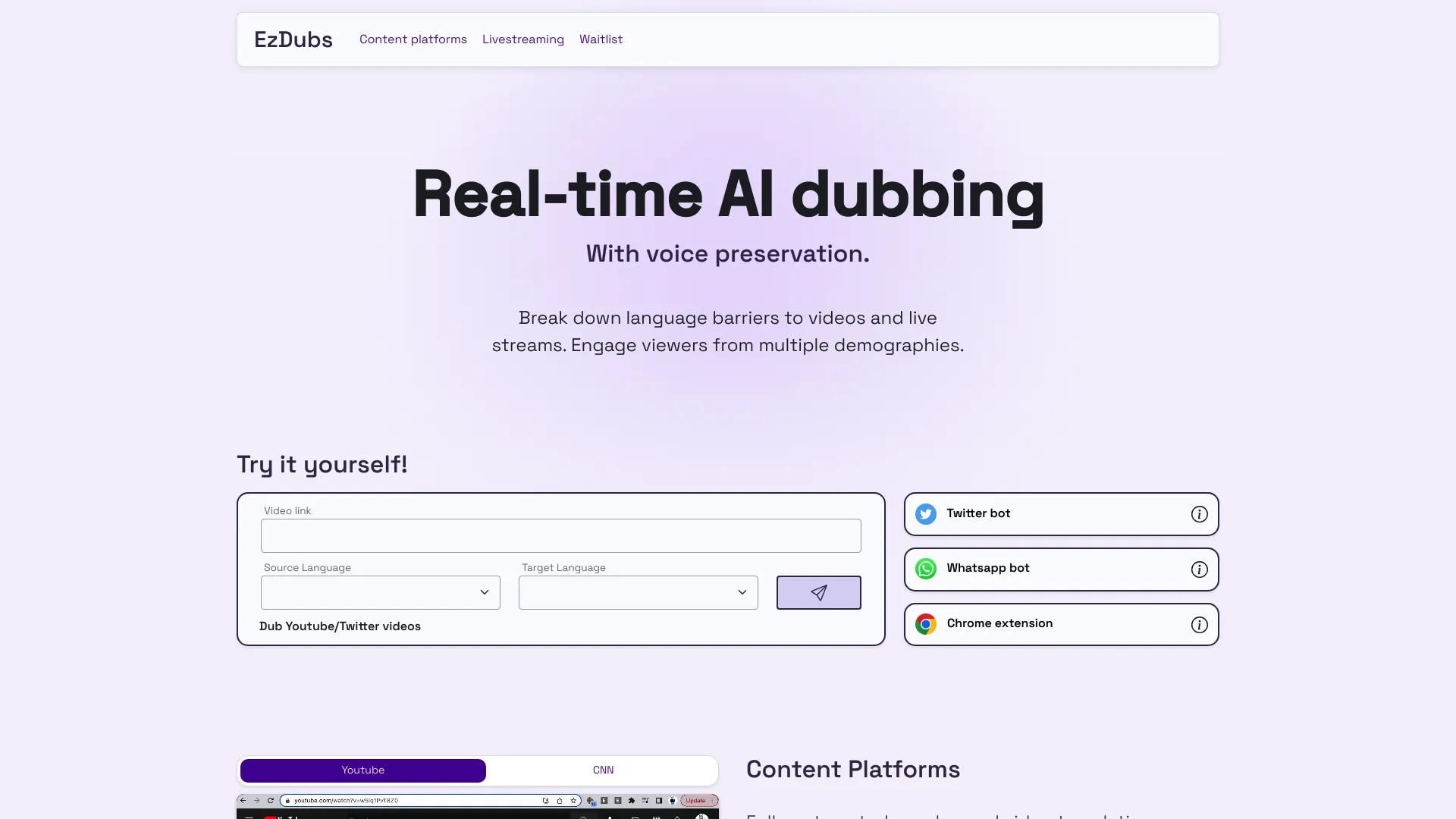

إذا كان كل هذا يبدو وكأنه الكثير من الأجزاء المتحركة، فهذا لأنه كذلك. والخبر السار هو أن هناك بالفعل أدوات وخدمات يمكنك التعلم منها أو حتى استخدامها مباشرة كإصدار أول من منتجك.

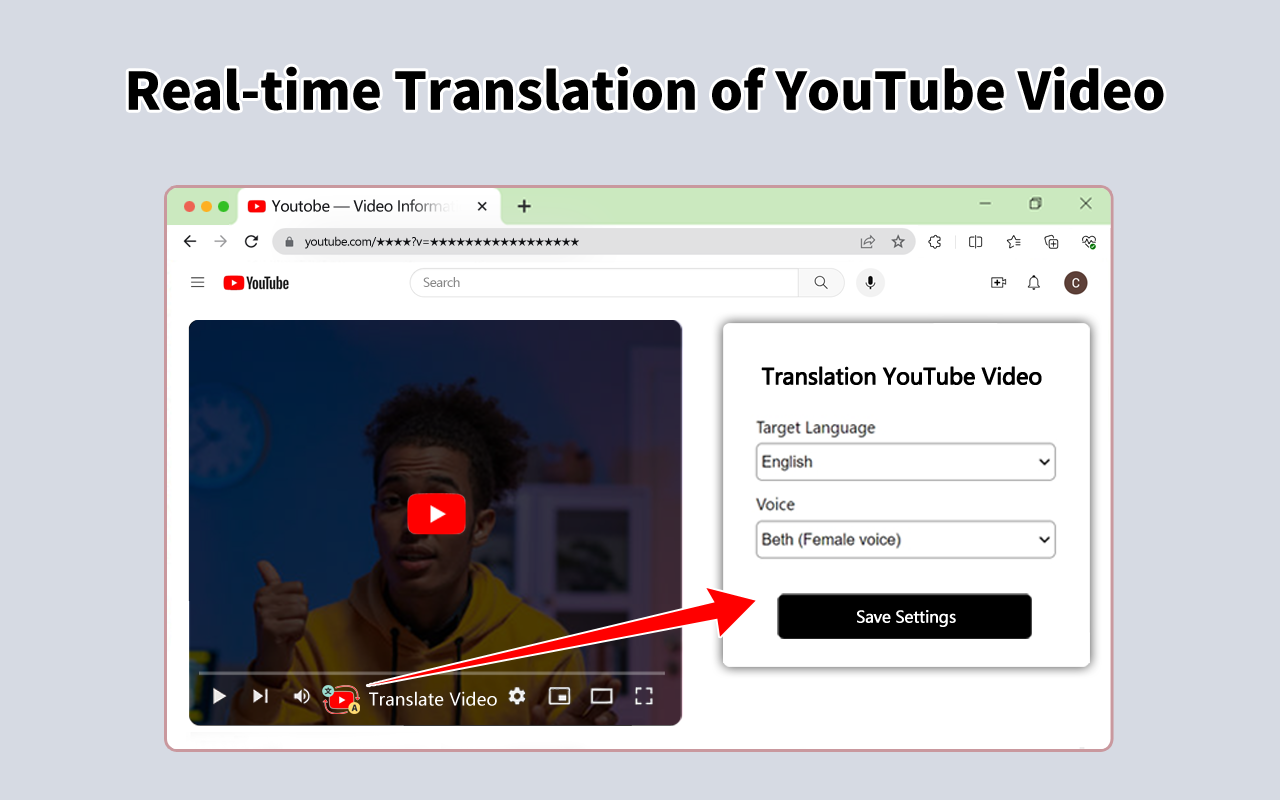

على سبيل المثال، تقدم Transmonkey دبلجة في الوقت الفعلي بأكثر من 130 لغة عبر امتداد المتصفح، مما يمنحك نقطة مرجعية رائعة لتوقعات تجربة المستخدم والأداء.دبلجة في الوقت الحقيقي بأكثر من 130 لغة

وعلاوة على ذلك، يقوم YouTube بتجربة تحسينات على تجربة المستخدم العالمية مثل الصور المصغرة الخاصة باللغات وتعديلات الاكتشاف، بحيث تنتقل الإصدارات المترجمة إلى لغات أخرى على المستوى الدولي. من الواضح أن تعدد اللغات لم يعد أمرًا متخصصًا بعد الآن - بل هو التوقع الافتراضي.

تُظهر التقارير عن اختبار YouTube لميزات مصغّرة جديدة لمساعدة مقاطع الفيديو على السفر عالميًا أن المنصة تعمل بشكل متزايد على تحسين الاكتشاف عبر الحدود.مقاطع فيديو تسافر حول العالم

ومع ذلك، إذا كنت مؤسساً تقنياً أو كنت ترغب في دمج الدبلجة بإحكام مع منتجك الخاص، فستحتاج في مرحلة ما إلى بنية خاصة بك. هذا هو المكان الذي يجب أن تفكر فيه ليس فقط في مكونات التعلم الآلي، ولكن أيضًا في الجدولة والتحليلات وتحقيق الدخل والصيانة - وهي مجالات مؤلمة بشكل مدهش إذا كنت تعتمد على خمس أدوات SaaS منفصلة مربوطة معًا.

سبب أهمية مكدس المبدعين الكل في واحد

قد يستخدم الإعداد النموذجي الذي يتم إجراؤه بنفسك أحد مقدمي خدمات الترجمة الآلية الآلية، وآخر للترجمة، وثالث لترجمة النص الفوري، ولوحة تحكم منفصلة للتحليلات، وأداة أخرى لجدولة ونشر المحتوى متعدد اللغات. كل عملية تكامل عبارة عن لغم صغير: حدود واجهة برمجة التطبيقات، وانتهاء صلاحية رموز المصادقة، والتسجيل غير المتناسق، وتذاكر الدعم التي تنتقل بين مزودي الخدمة عندما يحدث خطأ ما.

وهنا يبرز نهج المنصة الموحدة. على سبيل المثال، تجمع UUININ بين إمكانات إنشاء محتوى الذكاء الاصطناعي مثل التحرير المتقدم للفيديو ومعالجة الصوت وتوليد المحتوى الآلي مع أدوات تحسين الذكاء الاصطناعي للتوصيات الذكية وأتمتة سير العمل. في سياق الدبلجة في الوقت الفعلي، هذا يعني أنه يمكنك وضع نموذج أولي لمراجعة الصوت في الوقت الفعلي ← الترجمة ← خط أنابيب تحويل النص إلى كلام، ومراقبة زمن الاستجابة والتفاعل وتغذية رؤى الأداء في جدول النشر واستراتيجية اللغة - كل ذلك داخل منظومة واحدة بدلاً من التنقل بين لوحات تحكم متعددة.

لماذا تتنقل بين أكثر من 5 أدوات مختلفة بينما يمكنك التعامل مع تحرير الذكاء الاصطناعي والصوت متعدد اللغات والتحليلات والنشر من منصة واحدة تعرف بالفعل كيف يتناسب سير عملك بالكامل معًا؟

وبالإضافة إلى توفير رسوم الاشتراك، فإن الميزة الأكثر دقة هي التحسين: عندما يتشارك خط أنابيب الدبلجة والجدول الزمني للتحرير وتحليلات الجمهور البيانات يمكنك الإجابة عن أسئلة مثل "أي لغة دبلجة تجعل المشاهدين يشاهدون لفترة أطول؟" و "هل يجب أن ندبلج البث المباشر تلقائيًا أم فقط VODs؟

من النموذج الأولي إلى المنتج: أنماط تجربة المستخدم الناجحة

إذا كنت تصمّم للمشاهدين، يهيمن نمطين لتجربة المستخدم: ملحقات المتصفح التي تزيد من موقع YouTube، وتطبيقات الويب المصاحبة التي تضم مشغل YouTube. تبدو الإضافات أكثر محلية (تبقى على youtube.com)، بينما تمنحك تطبيقات الويب مزيدًا من التحكم في التخطيط وأحيانًا يكون من الأسهل شحنها عبر المتصفحات.

- محدّد اللغة - من الضروري وجود قائمة منسدلة أو مفتاح تبديل بسيط بالقرب من المشغّل؛ يجب أن يكون المستخدمون قادرين على التبديل بين الصوت الأصلي والمدبلج على الفور.

- مؤشر زمن التأخير - ضع في اعتبارك شارة "مباشر" أو "+0.8 ثانية" صغيرة لتحديد التوقعات بشأن التأخير.

- الأوضاع الاحتياطية - إذا انخفضت الجودة، فارجع إلى الترجمة أو اعرض تحذيرًا بدلاً من بث صوت رديء.

بالنسبة لمنشئي المحتوى، قد ترغب أيضًا في وضع "التأليف" حيث يمكنهم معاينة الدبلجة وتعديل المصطلحات (أسماء المنتجات، النكات المتكررة) وتثبيت العبارات المهمة قبل النشر. هذا هو المكان الذي يصبح فيه التحرير بمساعدة الذكاء الاصطناعي ذا قيمة: بدلاً من قص الأسطر يدويًا وإعادة تسجيلها، يمكن للنظام إعادة إنشاء المقاطع بترجمات أو نطق محدث في دقائق.

تصميم حزمة دبلجة عملية في الوقت الحقيقي

دعنا نجمع القطع معًا في بنية عملية يمكن لفريق مستقل شحنها. لستَ بحاجة إلى إعادة اختراع ASR أو TTS من الصفر؛ فمهمتك هي تنسيق خط الأنابيب وتصميم تجربة المستخدم.

- تقوم إضافة المتصفح أو تطبيق الويب بالتقاط صوت YouTube في أجزاء قصيرة (على سبيل المثال، ثانية واحدة).

- يتم بث القطع إلى الواجهة الخلفية عبر WebSocket (أو قنوات بيانات WebRTC لتقليل النفقات العامة).

- تقوم الواجهة الخلفية بتشغيل دفق ASR، وتدفع النصوص الجزئية إلى خدمة الترجمة.

- يتم تغذية النص المترجم إلى محرك تحويل النص إلى كلام فوري منخفض الكمون يقوم بإخراج إطارات صوتية.

- تقوم الواجهة الخلفية ببث إطارات الصوت المركبة إلى المتصفح.

- تقوم الواجهة الأمامية بتشغيل الصوت المدبلج بتأخير ثابت صغير، مع كتم الصوت أو تخفيف المسار الأصلي.

- تسجِّل التحليلات اختيار اللغة، وزمن الاستجابة، ومعدلات الإكمال لتحسينها لاحقًا.

إذا كنت مبدعًا في المقام الأول وليس مهندسًا للمعلوماتية، فمن المحتمل أن تستخدم واجهات برمجة التطبيقات المدارة ASR/MT/TTS في البداية. ومع نمو استخدامك، يمكنك التبديل في النماذج مفتوحة المصدر المستضافة على وحدات معالجة الرسومات الخاصة بك للتحكم في التكاليف.

هنا مرة أخرى، يساعد نهج المنصة. يمكن لمكدس إنشاء محتوى الذكاء الاصطناعي في UUININ، الذي يتعامل بالفعل مع تحرير الفيديو بالذكاء الاصطناعي وتحسين الصور ومعالجة الصوت، أن يكون بمثابة محور مركزي حيث يعيش خط أنابيب الدبلجة الخاص بك جنبًا إلى جنب مع سير عمل التحرير. بدلاً من تصدير الصوت المدبلج وإعادة استيراده إلى محرر منفصل وتحميله يدويًا إلى YouTube، يمكنك أتمتة السلسلة بأكملها: إنشاء صوت متعدد اللغات، ودمجه مع الجداول الزمنية الخاصة بك، وجدولة التحميلات أو البث إلى منصات متعددة باستخدام أدوات المنشئ الخاصة به للجدولة والنشر متعدد المنصات. وهذا يوفر الكثير من الوقت عندما تحتفظ بقنوات ولغات متعددة.

بالنسبة للفرق التي تنشئ برمجيات SaaS حول هذا الأمر، ضع في اعتبارك تقديم وضعي الوقت الحقيقي والدُفعات: الوقت الحقيقي للأحداث المباشرة وأدوات "المشاهدة أثناء التصفح"، والدفعات للمعالجة المسبقة للكتالوجات الخلفية بأكملها إلى لغات متعددة بجودة أعلى وتكلفة أقل في الدقيقة.

التكلفة والجودة والاعتبارات القانونية

معالجة الذكاء الاصطناعي في الوقت الحقيقي ليست مجانية. أنت تدفع مقابل الحوسبة وعرض النطاق الترددي وأصوات تحويل النص إلى كلام مكلفة في كثير من الأحيان. تكمن الحيلة في المواءمة بين الجودة والإيرادات: من المنطقي أن تنفق أكثر على المحتوى عالي القيمة مثل مقاطع الفيديو الدعائية أو المسلسلات الرئيسية أو الدورات التدريبية المتميزة، واستخدام نماذج أرخص أو حتى ترجمات للتجارب ذات العائد المنخفض.

- تحجيم الحوسبة - استخدم التحجيم التلقائي والتوجيه لكل لغة حتى لا تهدر وحدة معالجة الرسومات على غرف فارغة.

- التخزين المؤقت - يمكن تخزين المقاطع التي يعاد تشغيلها بشكل متكرر (المقدمات والنهايات) مؤقتًا كصوت تم عرضه مسبقًا.

- الموافقة - إذا قمت باستنساخ صوت أحد المبدعين، فاحصل على إذن صريح؛ وإذا قمت بدبلجة محتوى طرف ثالث، فاحترم حقوق النشر وشروط المنصة.

الجانب القانوني ليس مجرد كلام مرسل: في بعض الولايات القضائية، يمكن أن يؤدي استنساخ الصوت أو الترجمة غير المصرح بها إلى مشاكل حقيقية. عندما تكون في شك، استخدم الأصوات العامة بشكل افتراضي وكن شفافاً مع المستخدمين حول ما يتم إنشاؤه بواسطة الذكاء الاصطناعي وكيفية استخدامه.

من من منظور سير العمل، من السهل حرق ساعات من العمل في توصيل الفواتير والأذونات وتحليلات الاستخدام معًا عبر بائعين متعددين. يمكن لنظام مثل UUININ، الذي يدمج تحسين الذكاء الاصطناعي لسير العمل الآلي ورؤى الأداء مع محرك تحقيق الدخل ولوحة معلومات التحليلات، أن يكون قويًا بشكل خاص إذا كنت تخطط لتحقيق الدخل من الدبلجة - سواء عن طريق الوصول المدفوع متعدد اللغات أو التعاون مع العلامات التجارية أو عمليات البيع. يمكنك توجيه بيانات المشاركة متعددة اللغات مباشرةً إلى منطق تحقيق الدخل بدلاً من محاولة جمعها من خدمات متفرقة.

في نهاية المطاف، السؤال الكبير هو ما إذا كنت تريد أن تعمل على تجميع خمس أو ست واجهات برمجة تطبيقات إلى الأبد، أو أنك تفضل مستقبلاً يكون فيه خط أنابيب الدبلجة بالذكاء الاصطناعي ومجموعة التحرير والنشر متعدد اللغات وتحقيق الدخل جزءًا من نظام بيئي ذكي واحد لمنشئي المحتوى. تشير المنصات مثل UUININ إلى هذا المستقبل الموحد: أنت تصمم التجربة الإبداعية - متعددة اللغات وفي الوقت الحقيقي وسريعة الاستجابة - وتتولى المنصة المهام الثقيلة لتحرير الذكاء الاصطناعي، وتحسين المحتوى، وأتمتة سير العمل، والنشر عبر المنصات حتى تتمكن من التركيز على إنشاء مقاطع فيديو تستحق الترجمة في المقام الأول.

هل أحتاج حقًا إلى دبلجة بالذكاء الاصطناعي في الوقت الحقيقي، أم أن الدبلجة قبل العرض كافية؟

إذا كان معظم المحتوى الخاص بك مسجلاً مسبقًا (برامج تعليمية ومقالات ومراجعات)، فعادةً ما تكون الدبلجة المسبقة كافية ويمكن أن تصل إلى جودة أعلى لأنه يمكنك تحريرها ومراجعتها. تتألق الدبلجة بالذكاء الاصطناعي في الوقت الحقيقي عندما تريد تجارب مباشرة أو شبه مباشرة: البث المباشر أو العروض الأولى أو أدوات المتصفح "شاهد أي فيديو بأي لغة" التي تعمل على قنوات عشوائية.

ما مقدار الخبرة البرمجية التي أحتاجها لبناء نموذج أولي؟

يجب أن تكون مرتاحًا في استخدام JavaScript أو TypeScript لعمل المتصفح، بالإضافة إلى لغة خلفية (Node أو Python أو Go) لتنسيق ASR وMT وTTS. لستَ بحاجة إلى أن تكون خبيرًا في التعلم الآلي؛ يمكنك البدء بواجهات برمجة التطبيقات المُدارة واستبدالها بنماذج مخصصة لاحقًا إذا لزم الأمر.

هل ستؤدي ميزات YouTube الرسمية في نهاية المطاف إلى الاستغناء عن الحلول المخصصة؟

ستغطي الدبلجة الصوتية المدمجة متعددة اللغات والذكاء الاصطناعي في YouTube العديد من حالات الاستخدام الشائعة، خاصة للقنوات الكبيرة. لكن الحلول المخصصة ستظل مهمة لمهام سير العمل المتخصصة، والتوزيع عبر المنصات، والتحكم الدقيق في جودة الترجمة، والمنتجات التي تقع بين YouTube والمشاهد (الإضافات والتطبيقات والمنصات التعليمية). فكّر في الأمر مثل المحرر المدمج في YouTube مقابل المحررين الخارجيين: كلاهما يتعايشان.

كيف يمكنني الحفاظ على زمن انتقال منخفض بما يكفي للبث المباشر؟

استخدم دفق ASR و TTS، وحافظ على أحجام القطع صغيرة (0.5-1 ثانية)، وقلل من القفزات عبر المناطق، وكن مستعدًا لمقايضة بعض التعقيد في الترجمة بالسرعة. يعتبر التأخير الثابت والصغير الذي يبلغ حوالي ثانية واحدة مقبولاً لمعظم المشاهدين ويمنح خط الأنابيب الخاص بك مساحة للتنفس.

هل يجب أن أقوم بتطوير البنية التحتية الخاصة بي أم أستخدم منصة منشئ المحتوى المتكاملة؟

إذا كنت تحب تشغيل البنية التحتية وتحتاج إلى التخصيص العميق، فلا بأس من دبلجة مجموعتك الخاصة. ولكن إذا كان هدفك الرئيسي هو نشر المحتوى وتحقيق الدخل منه بكفاءة، فمن المرجح أن تجعلك منصة شاملة تجمع بين تحرير الذكاء الاصطناعي وسير عمل الدبلجة والتحليلات وتحقيق الدخل - على غرار UUININ - تصل إلى السوق بشكل أسرع وبنفقات تشغيلية أقل بكثير.